|

“AI 模型,最终目标只有一个,就是模仿人类的思维” ——by Ruanyf](github一名贡献者)

┃任务说明 Ollama作为个人电脑上的大模型应用,已经成为我在mac笔记本电脑和windows pc上体验开源LLM大模型的首选服务,上一篇基于第三方插件把Ollama服务集成到了开源笔记软件Obsidian中,实现了笔记内的LLM问答。但RAG在Macbook中应用时性能开销始终比较大,同时我又不想通过api接口连接大模型云服务。这次看到有人推荐网易有道团队开源的QAnything,在Github看了下评价还不错,于是决定体验一下。

#AI应用-011 QAnything:一个基于增强检索生成(RAG)的知识库管理开源项目 用途示例2:结合知识库内容给出建议和意见↑ ┃QAnything 项目简介

项目介绍:QAnything是基于增强检索生成(RAG)的知识库管理开源项目,是网易有道团队开发。 项目地址:https://github.com/netease-youdao/QAnything 官方使用说明:https://github.com/netease-youdao/QAnything/blob/master/QAnything%E4%BD%BF%E7%94%A8%E8%AF%B4%E6%98%8E.md

┃我的本机环境 OS:Macbook(MacOS),M2芯片 大模型环境:ollama AI知识库开源项目:Qantying

QAnything使用的嵌入模型:BCEmbedding(包括embedding和rerank BCEmbedding嵌入模型优点:使用了embedding和rerank两个模型,进一步增加了检索的准确性。 使用到的大语言模型(LLMs):llama3,llama3-8b-chinese-chat-ollama-q8 部署方式:纯python环境安装,通过ollama使用本地开源模型

┃无废话0基础纯享部署步骤(但我还是希望你能看到后面我的部署体验过程) 1.自行安装Anaconda3(便于将QAnything部署在一个独享的纯净的python环境中) 2.打开mac终端窗口(推荐使用iTerm):

3.创建一个干净的Python虚拟环境,以避免潜在冲突

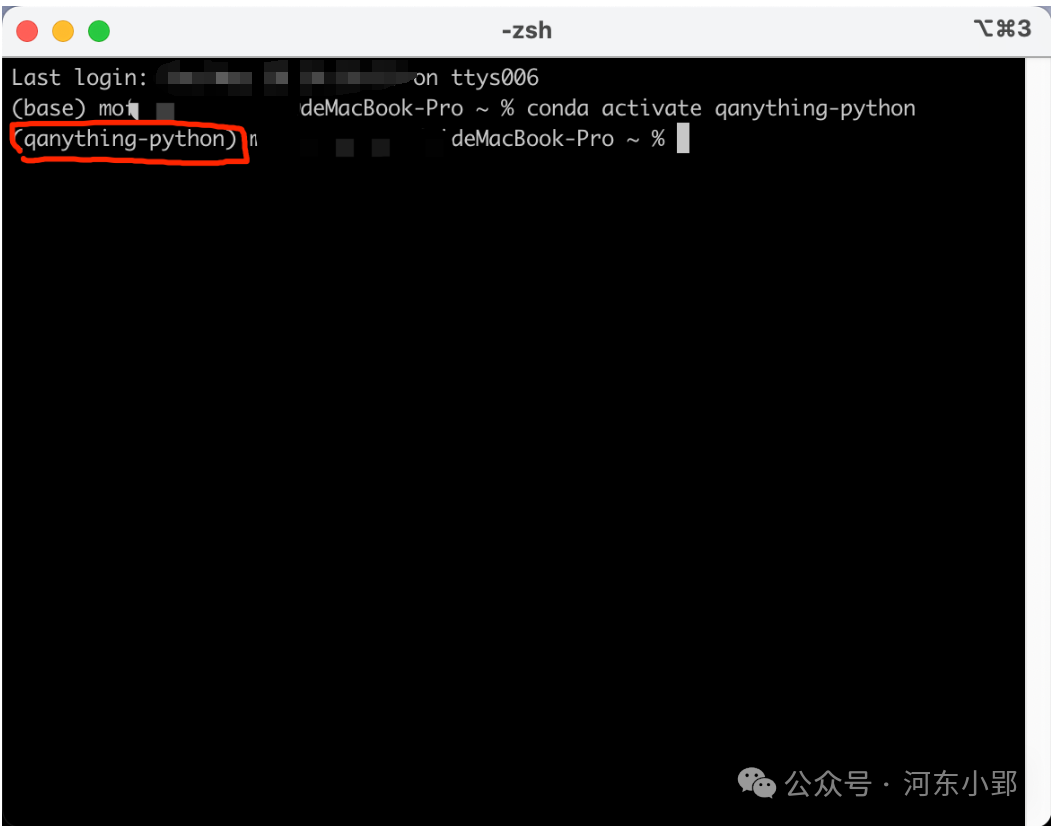

终端内输入以下命令,回车: condacreate-nqanything-pythonpython=3.10 4.步骤2执行成功后,终端内输入以下命令激活Qanything的python环境: condaactivateqanything-python

注意:如果终端设置了代理,这里是会报错的,需要在终端窗口取消代理(取消代理命令:exporthttps_proxy=http_proxy=all_proxy=),没有报错请忽略。 5.下载Qanything项目代码到本地(下载报错的话,就需要科学上网)gitclone-bqanything-pythonhttps://github.com/netease-youdao/QAnything.git 6.下载完毕后,窗口切换到Qanything文件夹 7.安装必要的python依赖环境(大概率需要科学上网,网速较好的情况下大概需要十分钟左右时间) pipinstall-rrequirements.txt 8.打开Qanything项目文件夹,找到run_for_ollama_M1_mac.sh文件,并右键选择【文本编辑】打开备用

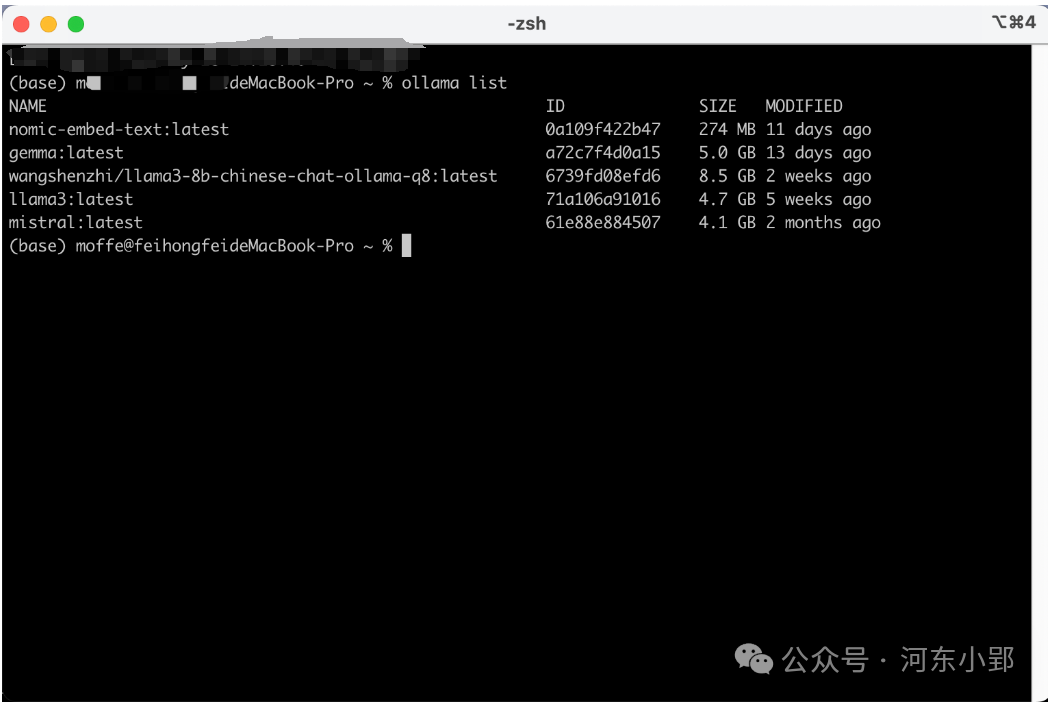

9.另外打开一个终端窗口,输入ollama list,查看安装了哪些大模型

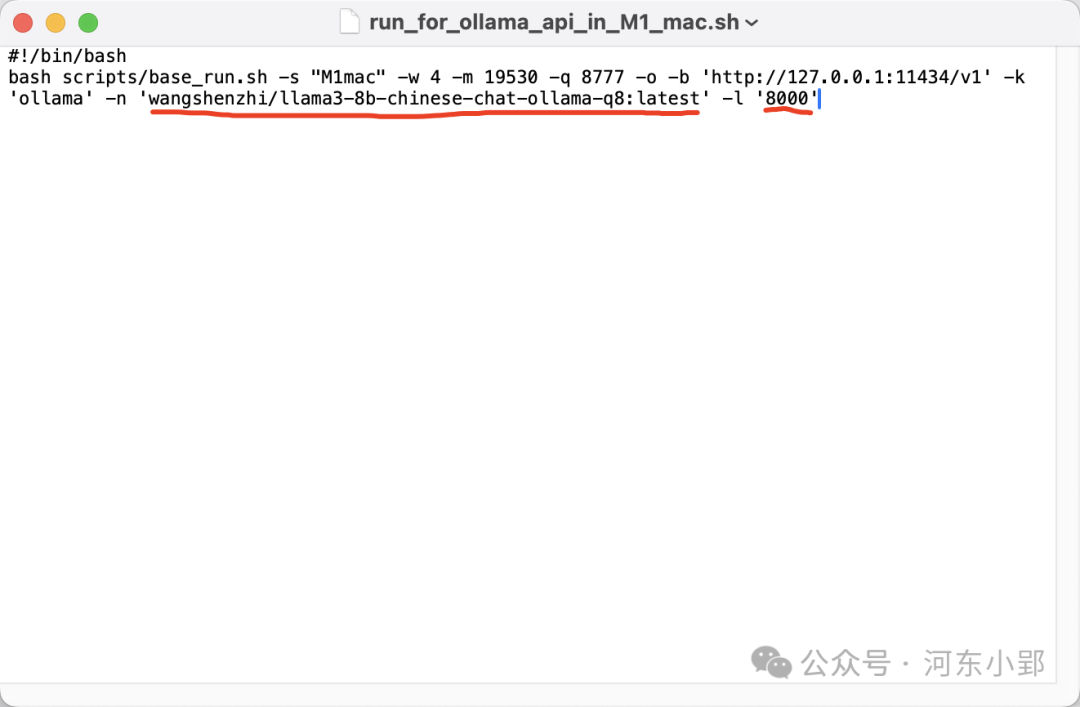

10.把想用的大模型拷贝拷贝出来,这里用的是“wangshenzhi/llama3-8b-chinese-chat-ollama-q8:latest”,注意“:latest”也要一并拷贝出来,复制到步骤8打开的文件中,上下文长度也一并改成8000(llama3的上下文长度为8K,llama2的上下文长度为4096), command+s保存(也会自动保存,习惯而已)

11.一定要启动ollama服务。有两种启动方式任选其一。 一种是另开一个终端窗口,输入:

另一种是找到ollama桌面程序,点击启动↓:

12.返回终端窗口,启动Qanything bashscripts/run_for_ollama_api_in_M1_mac.sh

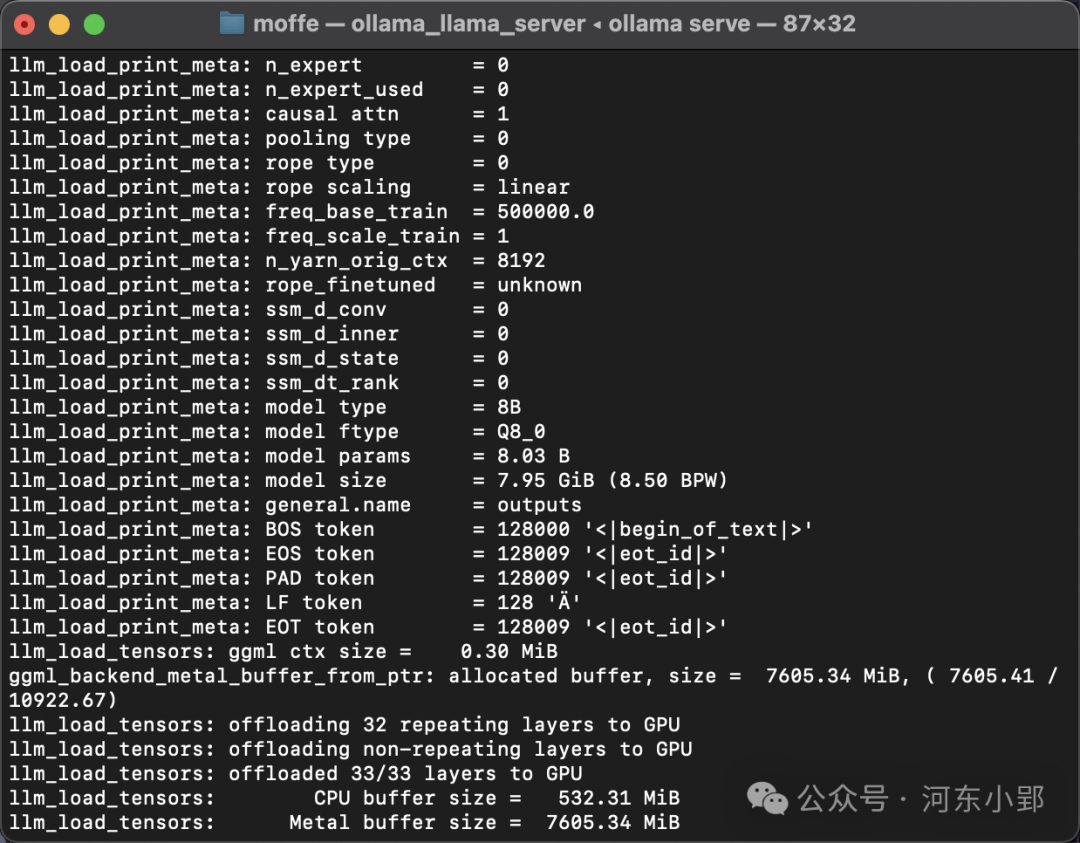

启动成功后的进程截图↑ 13.启动成功后,在浏览器输入http://127.0.0.1:8777/qanything/或者http://localhost:8777/qanything/访问QAnything 14.添加一个知识库,与知识库对话。(见开篇体验效果图)

#废话篇:献上我的“痛苦”体验过程,供一笑(安装部署参照上面即可,不要参考这里) DAY1: 1.创建一个干净的Python虚拟环境,以避免潜在冲突(推荐使用Anaconda3)。 condacreate-nqanything-pythonpython=3.10condaactivateqanything-python 注意:如果终端设置了代理的话,可能会以下报错(亲测?): ProxyError:Condacannotproceedduetoanerrorinyourproxyconfiguration.Checkfortyposandotherconfigurationerrorsinany'.netrc'fileinyourhomedirectory,anyenvironmentvariablesendingin'_PROXY',andanyothersystem-wideproxyconfigurationsettings. 如果报错上述错误,在mac终端窗口输入取消终端代理命令:export https_proxy= http_proxy= all_proxy= 2.下载项目代码到本地 gitclone-bqanything-pythonhttps://github.com/netease-youdao/QAnything.gitcdQAnythingpipinstall-rrequirements.txt#请根据使用环境选择启动脚本:bashscripts/xxx(内部调用纯python启动代码,可手动修改python启动命令) 3.安装必要的依赖环境

pip install -r requirements.txt (顺利的话,大概需要10分钟内) 注意:如果安装失败,大概率是因为网络环境,需要科学上网(亲测?) 如果要用本地的ollama大模型服务,需要打开项目文件夹,找到run_for_ollama_api_in_M1_mac.sh,按住command+c command+v复制一份

我的mac是m2芯片,重新把文件命名为run_for_ollama_api_in_M2_mac.sh

鼠标右键选择用‘文本文件’打开,编辑里面的命令,原始的命令如下: #!/bin/bashbashscripts/base_run.sh-s"M2mac"-w4-m19530-q8777-o-b'http://localhost:11434/v1'-k'ollama'-n'llama3'-l'4096'

在mac终端命令窗口输入ollama list,找到已经存在本地的大模型名称,选择一个你想用的大模型,替换到上面bash命令中去

修改后的 #!/bin/bashbashscripts/base_run.sh-s"M2mac"-w4-m19530-q8777-o-b'http://localhost:11434/v1'-k'ollama'-n'wangshenzhi/llama3-8b-chinese-chat-ollama-q8'-l'4096'

在mac终端执行 bashscripts/run_for_ollama_api_in_M1_mac.sh

启动成功后显示如下:按照命令窗口提示的url在浏览器输入:http://0.0.0.0:8777/qanything/后报错改成http://127.0.0.1:8777/qanything/或者http://localhost:8777/qanything/即可正常访问。 上传一个pdf文件

看起来还不错,来问一下问题,不出意外出了意外,报502错误。

把mac终端窗口的日志按照ctrl+a&ctrl+c拷贝到一个文档里面来,搜索“502”,找到以下报错信息: ……INFO:debug_logger:Warning:==wangshenzhi/llama3-8b-chinese-chat-ollama-q8notfound==.Usingcl100k_baseencoding.INFO:debug_logger:Warning:wangshenzhi/llama3-8b-chinese-chat-ollama-q8mayupdateovertime.Returningnumtokensassuminggpt-3.5-turbo-1106.INFO:debug_logger:prompttokens:160INFO:debug_logger:streaming:TrueINFO:debug_logger:[{'role':'user','content':'\n-你是一个耐心、友好、专业的机器人,能够回答用户的各种问题。\n-根据知识库内的检索结果,以清晰简洁的表达方式回答问题。\n-不要编造答案,如果答案不在经核实的资料中或无法从经核实的资料中得出,请回答“我无法回答您的问题。”(或者您可以修改为:如果给定的检索结果无法回答问题,可以利用你的知识尽可能回答用户的问题。)\n'}]**INFO:debug_logger:ErrorcallingOpenAIAPI:Errorcode:502**INFO:debug_logger:add_qalog:我想学习LLM知识,应该从何学起INFO:qa_logger:chat_data:{'user_id':'zzp','bot_id':'BOT30dbf5e2497549849b5c000a4bdc7e29','kb_ids':['KB0e708ac07d864e40af4d90d7daf341ac','KB0e708ac07d864e40af4d90d7daf341ac_FAQ'],……

看起来是ollama服务没找到我想要用的大模型,想起来自己的ollama服务可能没开起来,把ollama服务启动起来

在mac终端窗口按住control+c结束当前命令

重新输入 bashscripts/run_for_ollama_api_in_M1_mac.sh 重新打开本地页面,依然报错: 经过一宿的努力,还是失败,第二天看了「博金斯的AI笔记」解决知识库问答质量低 , QAnything 二段检索( Mac M2环境 ),突然灵光乍现,把sh参数修改成:#!/bin/bashbashscripts/base_run.sh-s"M1mac"-w4-m19530-q8777-o-b'http://127.0.0.1:11434/v1'-k'ollama'-n'llama3:latest'-l'8000'

敲重点:这里的'llama3:latest' 要与ollama list里带出来的模型名称保持一致!!!

重启应用 cd qanythingconda activate qanything-python

bash scripts/run_for_ollama_api_in_M1_mac.sh

终于成功!

考虑到llama3原生的对中文支持不好,换一个中文微调过的模型。

通过ollama list 找到已经安装到ollama服务里的模型,我这里用的是wangshenzhi/llama3-8b-chinese-chat-ollama-q8:latest;

修改run_for_ollama_api_in_M1_mac.sh文件 #!/bin/bashbashscripts/base_run.sh-s"M1mac"-w4-m19530-q8777-o-b'http://127.0.0.1:11434/v1'-k'ollama'-n'wangshenzhi/llama3-8b-chinese-chat-ollama-q8:latest'-l'8000' mac终端重启Qanthing服务↓: bashscripts/run_for_ollama_api_in_M1_mac.sh

Tips(痛苦复盘):

在启动Qanything服务后,总是报错,后台日志显示了没有找到llama3,本来不以为意,因为我在本地的ollama服务、chatbox、obsidian都是用同样的ollama配置,结果到了Qanything上不起作用。 这类的问题也不稀奇,本人从去年初开始,在体验AI项目特别是开源项目时,遇到了各种坑。这些坑对于LLM的初学者是不太友好的,比如过程中python组件包的各种冲突,会不得不去了解和实践在conda环境、docker中部署,熟悉去使用各种终端命令、代理设置,去找到大佬们的分享文章和视频逐帧对比亦步亦趋部署等等。 但也正因为这些折腾,在实践过程中,才能一点一点理解大模型对话机制(chatbot)、增强检索(RAG)、依赖的环境、资源的消耗等这些光靠看文章所无法直观面对的细节。 在AIGC实践中,找到知识的缝隙,日积月累,必有所获吧。

PS:封面由comfyui生成,提示词是从AIGC社群里看到的:Ink painting style, Simplistic and rough, Comic style, Dynamic, Subtle colors, solid white background, a Chinese young man, black long hair, full body, traditional Chinese clothes

|