|

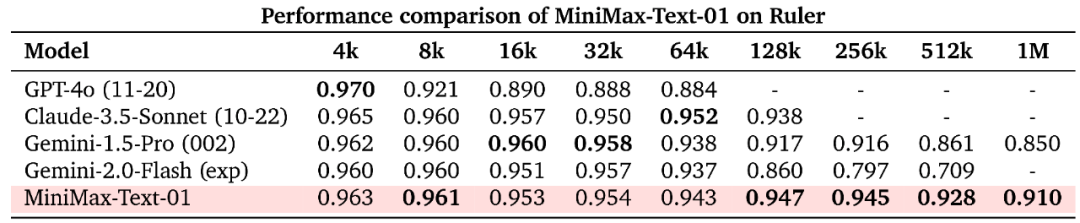

在 MiniMax-01系列模型中,我们做了大胆创新:首次大规模实现线性注意力机制,传统Transformer架构不再是唯一的选择。这个模型的参数量高达4560亿,其中单次激活459亿。模型综合性能比肩海外顶尖模型,同时能够高效处理全球最长400万token的上下文,是GPT-4o的32倍,Claude-3.5-Sonnet的20倍。 我们相信2025年会是Agent高速发展的一年,不管是单Agent的系统需要持续的记忆,还是多Agent的系统中Agent之间大量的相互通信,都需要越来越长的上下文。在这个模型中,我们走出了第一步,并希望使用这个架构持续建立复杂Agent所需的基础能力。 极致性价比、不断创新 ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 15px;letter-spacing: 0.034em;">受益于架构的创新、效率的优化、集群训推一体的设计以及我们内部大量并发算力复用,我们得以用业内最低的价格区间提供文本和多模态理解的API,标准定价是输入token 1元/百万token,输出token 8元/百万token。欢迎大家在MiniMax开放平台体验、使用。 https://www.minimaxi.com/platformhttps://www.minimaxi.com/en/platform MiniMax-01系列模型在https://github.com/MiniMax-AI开源,后续也会持续更新。基于业界主流的文本和多模态理解测评,结果如下图所示,我们在大多数任务上追平了海外公认最先进的两个模型,GPT-4o-1120以及Claude-3.5-Sonnet-1022。在长文任务上,我们对比了之前长文最好的模型Google的Gemini。如图(c)所示,随着输入长度变长,MiniMax-Text-01是性能衰减最慢的模型,显著优于Google Gemini。 受益于我们的架构创新,我们的模型在处理长输入的时候有非常高的效率,接近线性复杂度。和其他全球顶尖模型的对比如下:

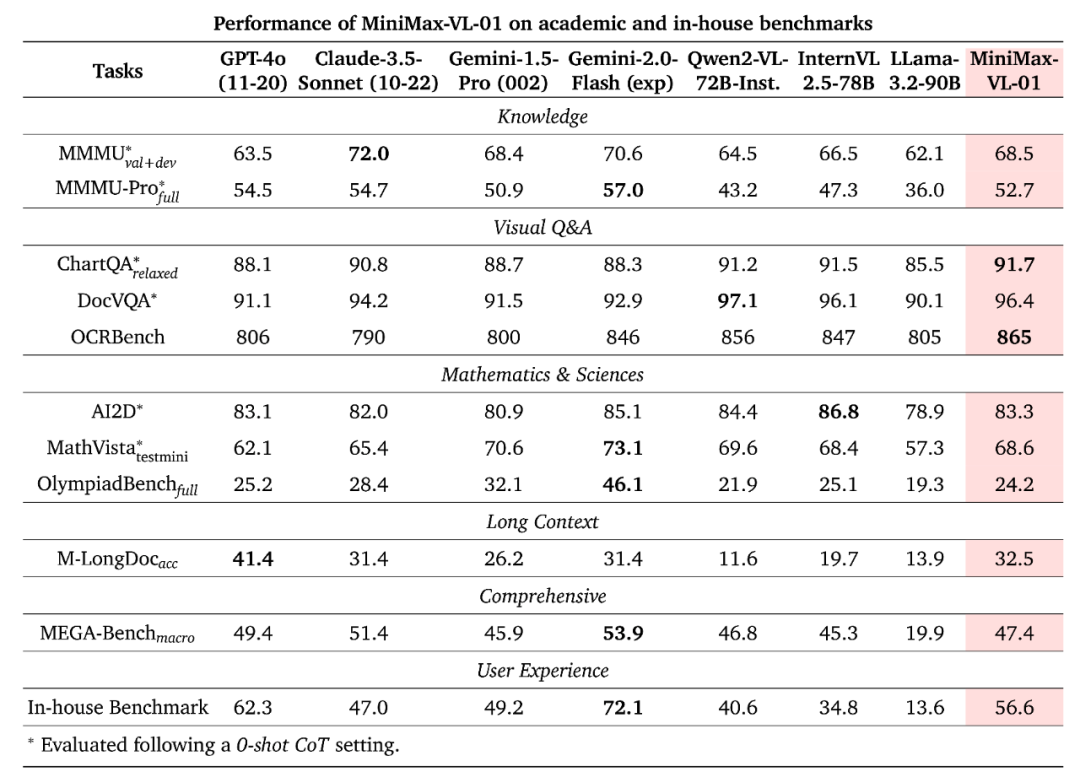

我们使用的结构如下,其中每8层中有7个是基于Lightning Attention的线性注意力,有1层是传统的SoftMax注意力。这是业内第一次把线性注意力机制扩展到商用模型的级别,我们从Scaling Law、与MoE的结合、结构设计、训练优化和推理优化等层面做了综合的考虑。由于是业内第一次做如此大规模的以线性注意力为核心的模型,我们几乎重构了训练和推理系统,包括更高效的MoE All-to-all通讯优化、更长的序列的优化,以及推理层面线性注意力的高效Kernel实现。在大部份的学术集上,我们都取得了比肩海外第一梯队的结果:

ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.034em;">在长上下文的ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.034em;">测评集ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.034em;">上,我们显著领先:

在400万的Needle-In-A-Haystack(大海捞针)检索任务上全绿: 除了学术数据集,我们构建了一个基于真实数据的助手场景中的测试集。在这个场景中,MiniMax-Text-01的模型表现显著领先,具体的对比如下:在多模态理解的测试集中,MiniMax-VL-01的模型也较为领先:

|