|

第一部分 衡量文本向量表示效果的榜单:MTEB、C-MTEB 1.1 《MTEB: Massive Text Embedding Benchmark(海量文本嵌入基准)》

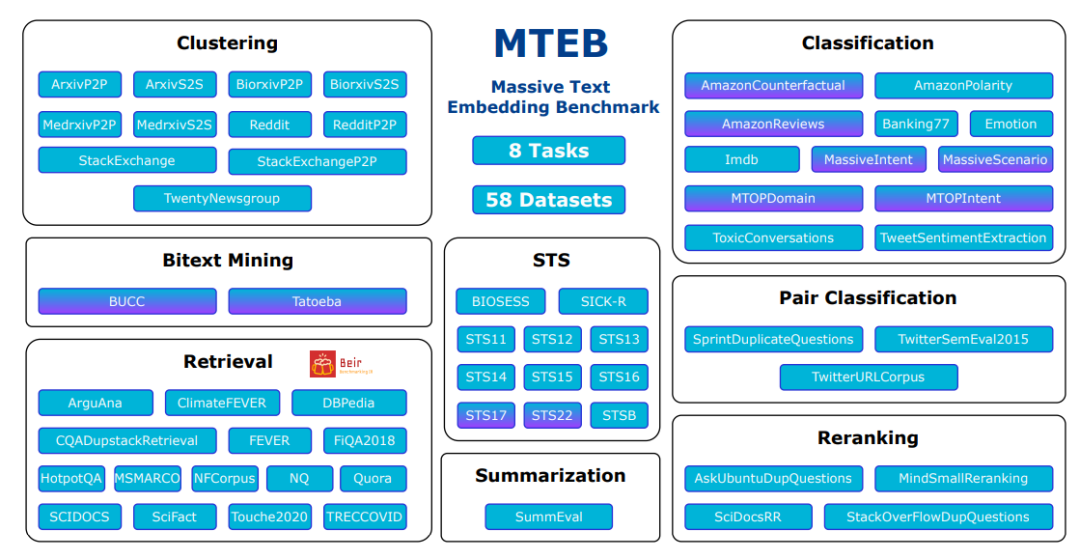

判断哪些文本嵌入模型效果较好,通常需要一个评估指标来进行比较,《MTEB: Massive Text Embedding Benchmark(海量文本嵌入基准)》就是一个海量文本嵌入模型的评估基准- 论文地址:https://arxiv.org/abs/2210.07316 MTEB包含8个语义向量任务,涵盖58个数据集和112种语言。通过在MTEB上对33个模型进行基准测试,建立了迄今为止最全面的文本嵌入基准。我们发现没有特定的文本嵌入方法在所有任务中都占主导地位。这表明该领域尚未集中在一个通用的文本嵌入方法上,并将其扩展到足以在所有嵌入任务上提供最先进的结果

- github地址:https://github.com/embeddings-benchmark/mteb#leaderboard

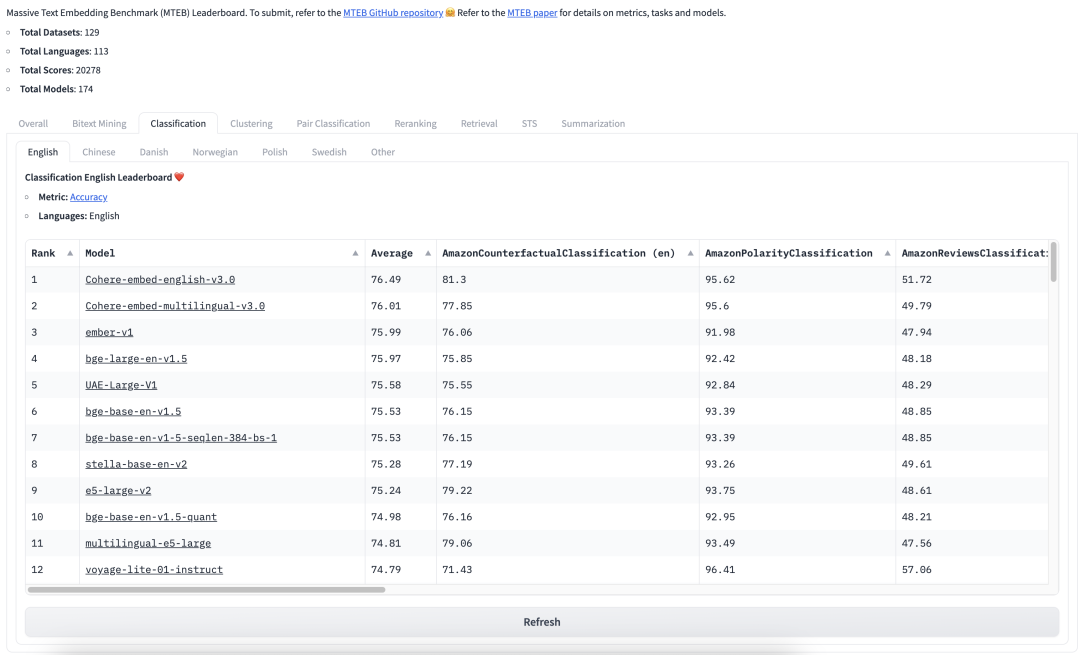

榜单地址:https://huggingface.co/spaces/mteb/leaderboard 1.2 中文海量文本embedding任务排行榜:C-MTEB

从Chinese Massive Text Embedding Benchmark中可以看到目前最新的针对中文海量文本embedding的各项任务的排行榜,针对不同的任务场景均有单独的排行榜。任务榜单包括: 其中,在本地知识库任务中,主要是根据问题query的embedding表示到向量数据库中检索相似的本地知识文本片段。因此,该场景主要是Retrieval检索任务。检索任务榜单如下: 目前检索任务榜单下效果最好的是bge系列的bge-large-zh模型,langchain-chatchat项目中默认的m3e-base也处于比较靠前的位置第二部分 OpenAI的text-embedding模型:从ada-002到3-small/3-large 目前检索任务榜单下效果最好的是bge系列的bge-large-zh模型,langchain-chatchat项目中默认的m3e-base也处于比较靠前的位置第二部分 OpenAI的text-embedding模型:从ada-002到3-small/3-large2.1 text-embedding-ada-002 text-embedding-ada-002是OpenAI于2022年12月提供的一个embedding模型,但需要调用接口付费使用。其具有如下特点: - 统一能力:OpenAI通过将五个独立的模型(文本相似性、文本搜索-查询、文本搜索-文档、代码搜索-文本和代码搜索-代码)合并为一个新的模型 在一系列不同的文本搜索、句子相似性和代码搜索基准中,这个单一的表述比以前的嵌入模型表现得更好

- 上下文:上下文长度为8192,使得它在处理长文档时更加方便

- 嵌入尺寸:只有1536个维度,是davinci-001嵌入尺寸的八分之一,使新的嵌入在处理矢量数据库时更具成本效益

以下是OpenAI官方文档中给出的用于文本搜索的代码实例 fromopenai.embeddings_utilsimportget_embedding, cosine_similarity

defsearch_reviews(df, product_description, n=3, pprint=True): embedding = get_embedding(product_description, model='text-embedding-ada-002') df['similarities'] = df.ada_embedding.apply(lambdax: cosine_similarity(x, embedding)) res = df.sort_values('similarities', ascending=False).head(n)returnres

res = search_reviews(df,'delicious beans', n=3)

2.3 最新发布的text-embedding-3之small/large的缩短嵌入技术 2.3 最新发布的text-embedding-3之small/large的缩短嵌入技术

2.3.1 OpenAI三大嵌入模型的嵌入维度对比 从上图可知,text-embedding-3-small/large这两个新嵌入模型允许开发者通过在 dimensions API 参数中传递嵌入而不丢失其概念表征属性,从而缩短嵌入(即从序列末尾删除一些数字)- 例如在 MTEB 基准上,text-embedding-3-large 可以缩短为 256 的大小, 同时性能仍然优于未缩短的 text-embedding-ada-002 嵌入(大小为 1536)

- 当然,仍然可以使用最好的嵌入模型 text-embedding-3-large 并指定 dimensions API 参数的值为 1024,使得嵌入维数从 3072 开始缩短,牺牲一些准确度以换取更小的向量大小

2.3.2 Matryoshka Representation LearningOpenAI 所使用的「缩短嵌入」方法,随后引起了研究者们的广泛注意,最终发现,这种方法和 2022 年 5 月的一篇论文所提出的「Matryoshka Representation Learning」方法是相同的(MRL 的一作 Aditya Kusupati 也评论道:OpenAI 在 v3 嵌入 API 中默认使用 MRL 用于检索和 RAG!其他模型和服务应该很快就会迎头赶上)不同于常规的fix的embedding表征,Matryoshka representation learning提出了一个方法,生成的表征是按照x下标进行重要性排序的,所以在资源受限的环境,可以只使用前面top-k维表征就可以如下所示,对于 ,考虑一组表示尺寸 ,考虑一组表示尺寸 ,对于输入数据 ,对于输入数据 中的数据点 中的数据点 ,其的目标是学习一个 ,其的目标是学习一个 维表示向量 维表示向量 ,对于每一个 ,对于每一个 ,MRL的目标是让前 ,MRL的目标是让前 维的表征向量 维的表征向量 独立地成为可转移的通用表征向量 独立地成为可转移的通用表征向量 再比如,在ImageNet-1K上训练ResNet50,将224×224像素的图像嵌入d=2048表示向量,然后通过线性分类器在 再比如,在ImageNet-1K上训练ResNet50,将224×224像素的图像嵌入d=2048表示向量,然后通过线性分类器在 个标签中进行预测 个标签中进行预测 - 对于MRL,选择

作为嵌套维度 假设得到了一个带标签的数据集 作为嵌套维度 假设得到了一个带标签的数据集 ,其中 ,其中 是输入点, 是输入点, 是所有 是所有 中 中 的标签 的标签 - MRL采用标准的经验风险最小化方法,通过使用独立的线性分类器对每个嵌套维度

进行多类分类损失优化,参数化为 进行多类分类损失优化,参数化为 之后,所有损失分别按各自的重要性 之后,所有损失分别按各自的重要性 进行适当缩放后,做最终聚合MRL optimizes the multi-class classification loss for each of the nested dimension m ∈M using standard empirical risk minimization using a separatelinear classifier, parameterized by W(m) ∈RL×m . 进行适当缩放后,做最终聚合MRL optimizes the multi-class classification loss for each of the nested dimension m ∈M using standard empirical risk minimization using a separatelinear classifier, parameterized by W(m) ∈RL×m .

All the losses are aggregated after scaling withtheir relative importance (cm ≥0)m∈M respectively 尽管只对 嵌套维度进行优化,MRL仍能产生精确的表示,并对介于所选表示粒度之间的维度进行插值 嵌套维度进行优化,MRL仍能产生精确的表示,并对介于所选表示粒度之间的维度进行插值

3.1 m3e模型简介 M3E是Moka Massive Mixed Embedding的简称,解释一下Moka,表示模型由MokaAI训练,开源和评测,训练脚本使用uniem ,评测BenchMark使用 MTEB-zh Massive,表示此模型通过千万级(2200w+)的中文句对数据集进行训练 Mixed,表示此模型支持中英双语的同质文本相似度计算,异质文本检索等功能,未来还会支持代码检索

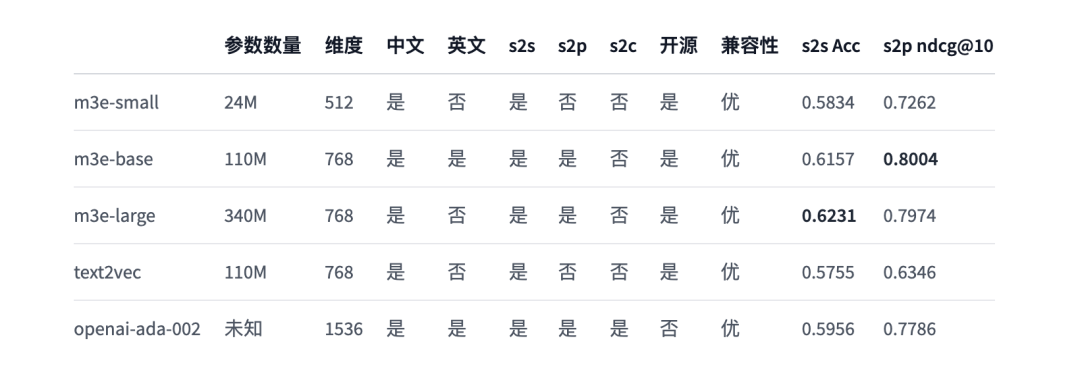

其有多个版本,分为m3e-small、m3e-base、m3e-large,m3e GitHub地址:GitHub - wangyingdong/m3e-base,其 使用in-batch负采样的对比学习的方式在句对数据集进行训练,为了保证in-batch负采样的效果,使用A100来最大化batch-size,并在共计2200W+的句对数据集(包含中文百科,金融,医疗,法律,新闻,学术等多个领域)上训练了 1 epoch 使用了指令数据集,M3E 使用了300W+的指令微调数据集,这使得 M3E 对文本编码的时候可以遵从指令,这部分的工作主要被启发于instructor-embedding 基础模型,M3E 使用Roberta系列模型进行训练,目前提供 small 和 base 两个版本 此文《知识库问答LangChain+LLM的二次开发:商用时的典型问题及其改进方案》中的langchain-chatchat便默认用的m3e-base

3.1.1 m3e与openai text-embedding-ada-002 以下是m3e的一些重大更新 2023.06.07,添加文本分类任务的评测结果,在 6 种文本分类数据集上,m3e-base 在 accuracy 上达到了 0.6157(至于m3e-large则是0.6231),超过了 openai-ada-002 的 0.5956 见下图s2s ACC那一列(其中s2s, 即 sentence to sentence ,代表了同质文本之间的嵌入能力,适用任务:文本相似度,重复问题检测,文本分类等)  此外,m3e团队建议 如果使用场景主要是中文,少量英文的情况,建议使用 m3e 系列的模型 多语言使用场景,并且不介意数据隐私的话,作者团队建议使用 openai text-embedding-ada-002 代码检索场景,推荐使用 openai text-embedding-ada-002 文本检索场景,请使用具备文本检索能力的模型,只在 S2S 上训练的文本嵌入模型,没有办法完成文本检索任务

3.2 m3e模型微调 fromdatasetsimportload_dataset

fromuniem.finetunerimportFineTuner

dataset = load_dataset('shibing624/nli_zh','STS-B')# 指定训练的模型为 m3e-smallfinetuner = FineTuner.from_pretrained('moka-ai/m3e-small', dataset=dataset)finetuner.run(epochs=3)

|