|

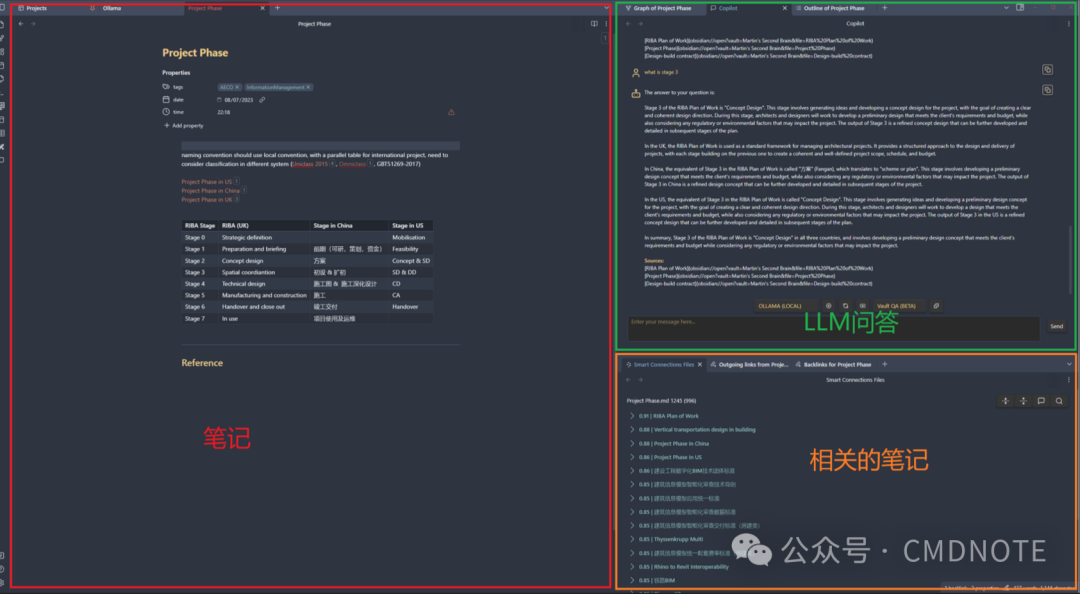

继续上次Obsidian里的AI应用。Obsidian里关于LLM的接口其实很早就有了,不过碍于国内用OpenAI的注册和付费比较麻烦我就一直没有弄。最近发现Obsidian Copilot这款插件能支持本地LLM了,测试了一下感觉体验还是很不错的。 最终实现的效果大概如下图:

相关的笔记是通过Smart Connection实现的,具体可以看之前的文章。 马丁陈,公众号:马丁的数字化笔记Obsidian - local embedding插件Smart Connections LLM问答是通过Obsidian Copilot这个插件+本地用Ollama跑了个llama2 7B模型实现的。 接下来来具体说说LLM问答这一部分怎么在我们自己电脑上弄。

国内用户下载需要解决网络问题 电脑配置决定你能使用多大的模型,越大的模型能力越强,但是要求的内存越多。比如使用默认的llama2 7B模型,电脑需要8G以上的内存。

第一步:安装Ollama和llama2 7B 下载安装Ollama,https://ollama.com/download 安装大模型,这里使用的是llama2 7B作为本地大语言模型和nomic-embed-text作为本地embedding模型,(这里国内朋友需要解决网络问题)。开始里搜索并打开cmd,然后在cmd里输入并运行下列命令, #下载llama2和nomic-embed-textollamapullllama2ollamapullnomic-embed-text#关闭ollama服务,可以看桌面右下角如果有个羊驼,可以右键关闭#设置OLLAMA_ORIGINS以供Obsidian可以访问ollamasetOLLAMA_ORIGINS=app://obisidian.md*

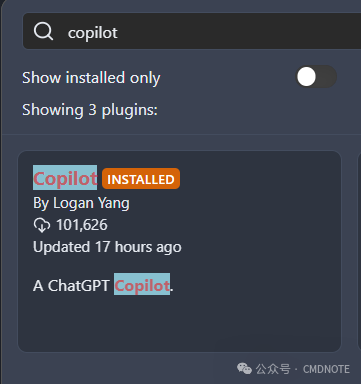

在Obsidian community plugin里搜索安装Copilot

每次要用的时候打开cmd,输入并运行ollama serve,这个窗口不要关

2. 在Obsidian里打开Copilot,设置模型是ollama,然后就可以用啦!

3. 用完后可以直接把cmd窗口关掉

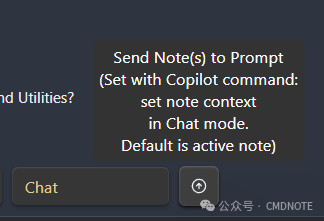

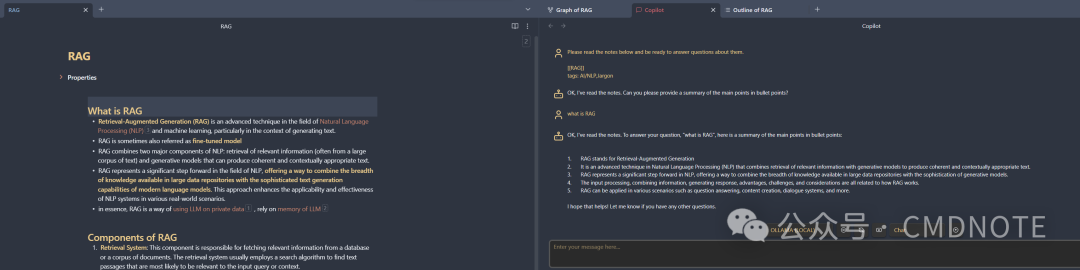

Chat功能除了基本问些有的没的之外,还能通过把你的笔记发送给大模型,让他先读一遍,然后再来问问题。

另外两个功能其实也挺有意思的,Long Note QA 用于太长的文件(哪天来聊聊context window和Token)

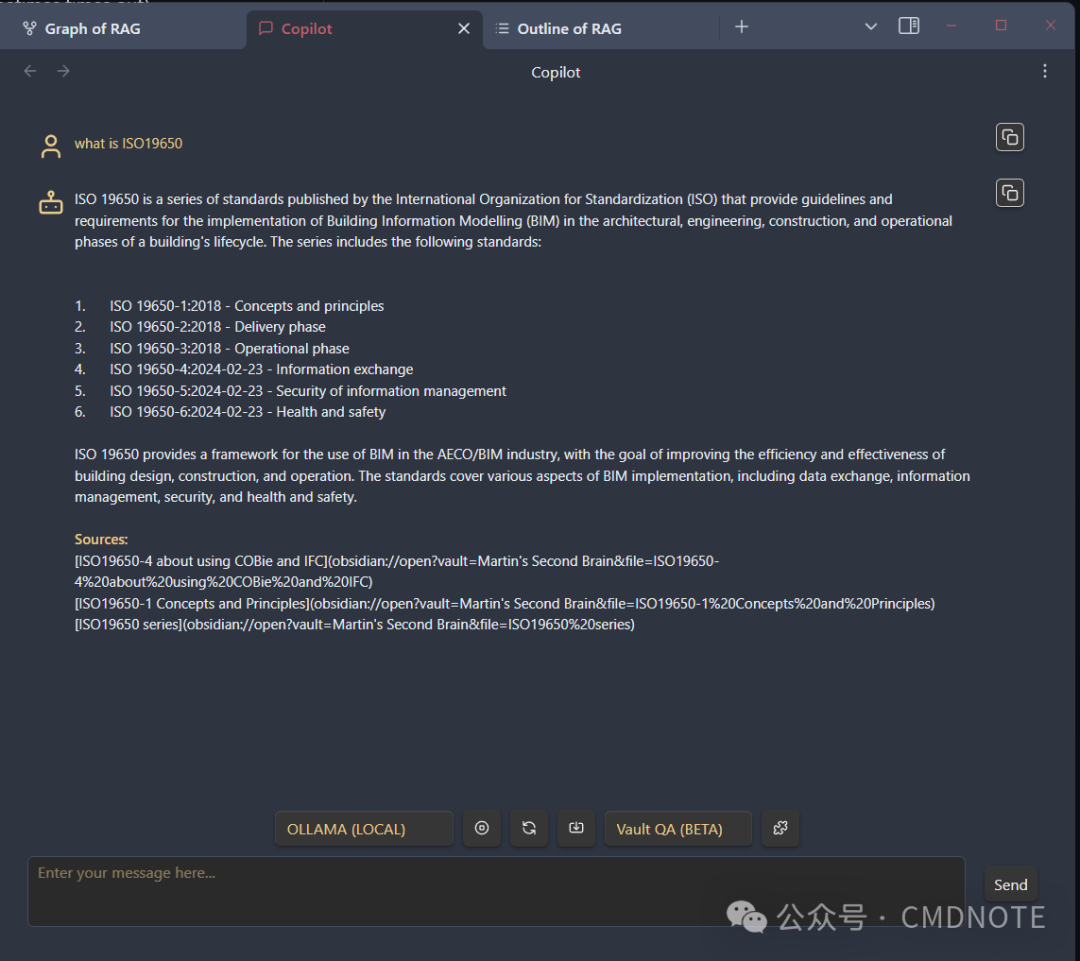

还有Vault QA,能通过知识库的内容,提供相关信息和索引。比如下面的问答里,Sources都是我笔记里有的内容。这个Notion AI的Q&A很像,但是免费!

|