|

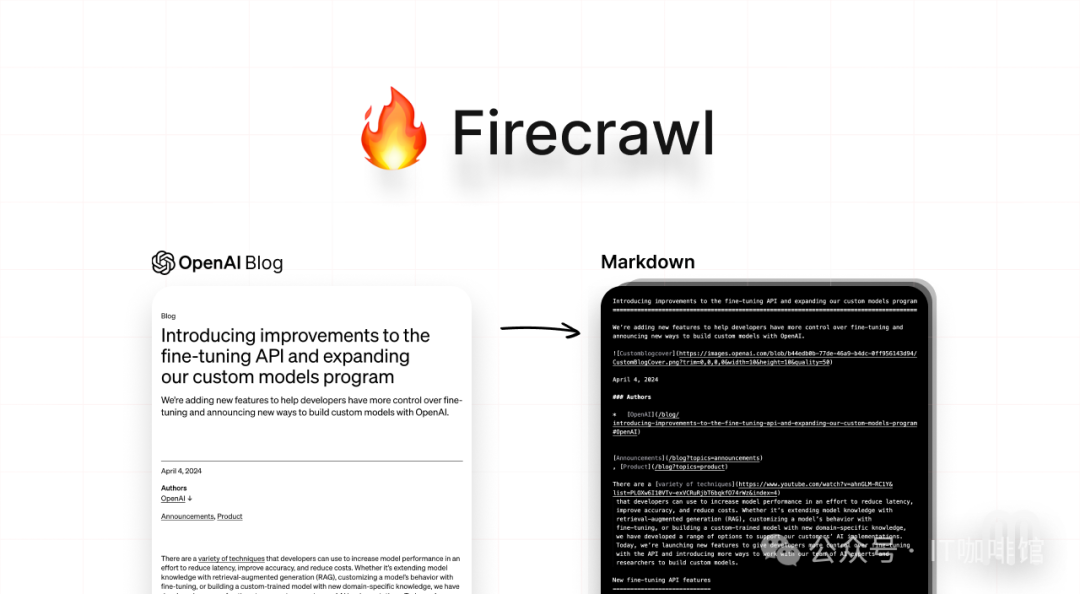

ingFang SC";font-weight: bold;color: rgb(255, 255, 255);line-height: 22px;">firecrawl 是什么 FireCrawl是一款创新的爬虫工具,它能够无需站点地图,抓取任何网站的所有可访问子页面。与传统爬虫工具相比,FireCrawl特别擅长处理使用JavaScript动态生成内容的网站,并且可以转换为LLM-ready的数据。

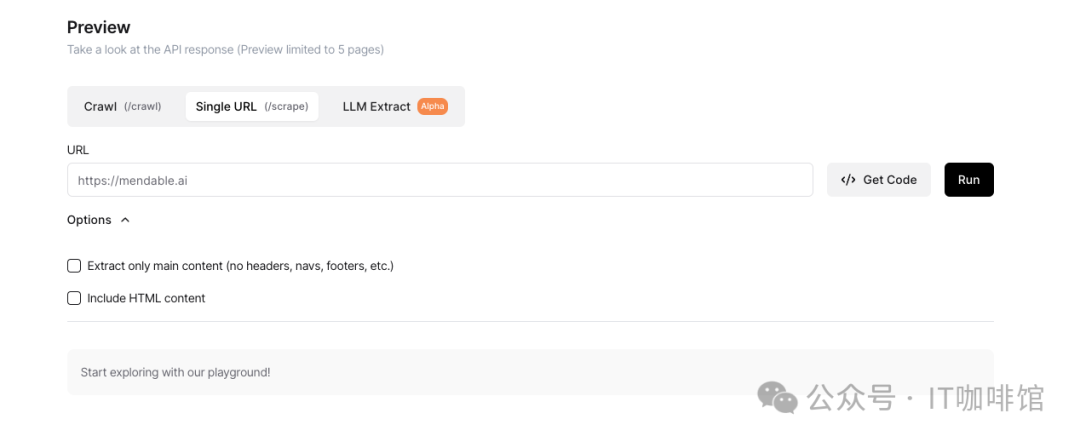

此外,它还提供了一个易于使用的API,让开发者能够轻松实现内容的爬取和转换。 可以先通过FireCrawl 提供的playground来快速体验下。

最简单的情况下,只需要填一个URL就可以,firecrawl会抓取到相关的内容,还可以通过LLM来提取信息。使用firecrawl的在线服务是需要付费的,免费的只有500credit,所以接下来我们看下如何自己本地运行。 ingFang SC";font-weight: bold;color: rgb(255, 255, 255);line-height: 22px;">本地运行项目的介绍中说了,目前还在早期阶段,不建议自己部署,如果想要跑可以源码启动。首先需要准备本地的环境:

然后在 /apps/api/ 下建一个 .env文件,可以从.env.example拷贝一个,.env.example中包括了项目可以使用的各种配置,内容很多。如果只是本地最简单运行的话,内容参考如下: # ===== Required ENVS ======NUM_WORKERS_PER_QUEUE=8PORT=3002HOST=0.0.0.0REDIS_URL=redis://localhost:6379

## To turn on DB authentication, you need to set up supabase.USE_DB_AUTHENTICATION=false

之后就是安装依赖。

接下来启动项目,这里启动需要涉及3个部分的内容。 启动Redis,在项目目录下打开一个终端,之后启动Redis即可

启动worker,worker是具体执行爬虫任务的,在项目的 /apps/api/ 路径下,执行命令:

启动主服务,还是在项目的 /apps/api/ 路径下,执行命令

到这里我们就在本地运行了firecrawl,可以向3002端口发个请求来确认服务已经运行 curl-XGET<http://localhost:3002/test>

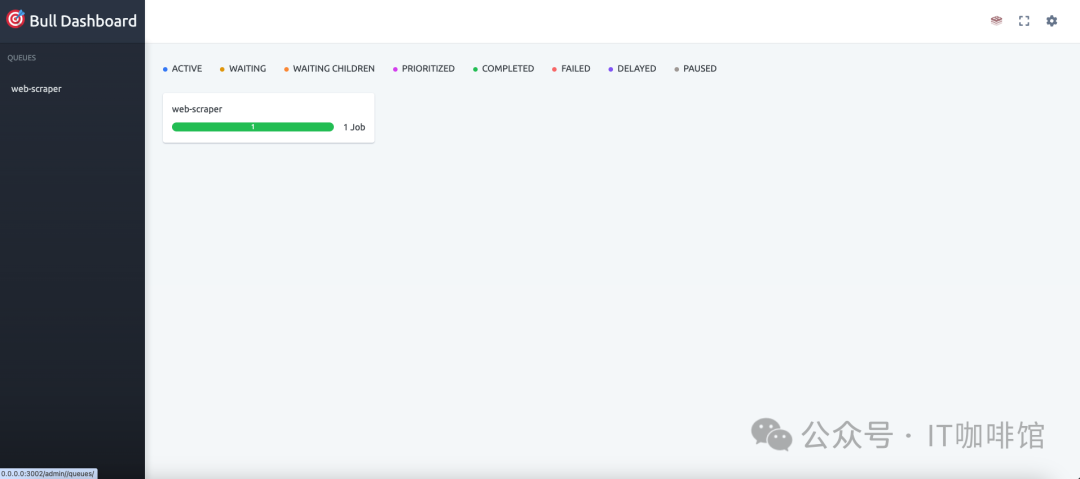

也可以访问 http://0.0.0.0:3002/admin//queues ,查看firecrawl的管理后台。

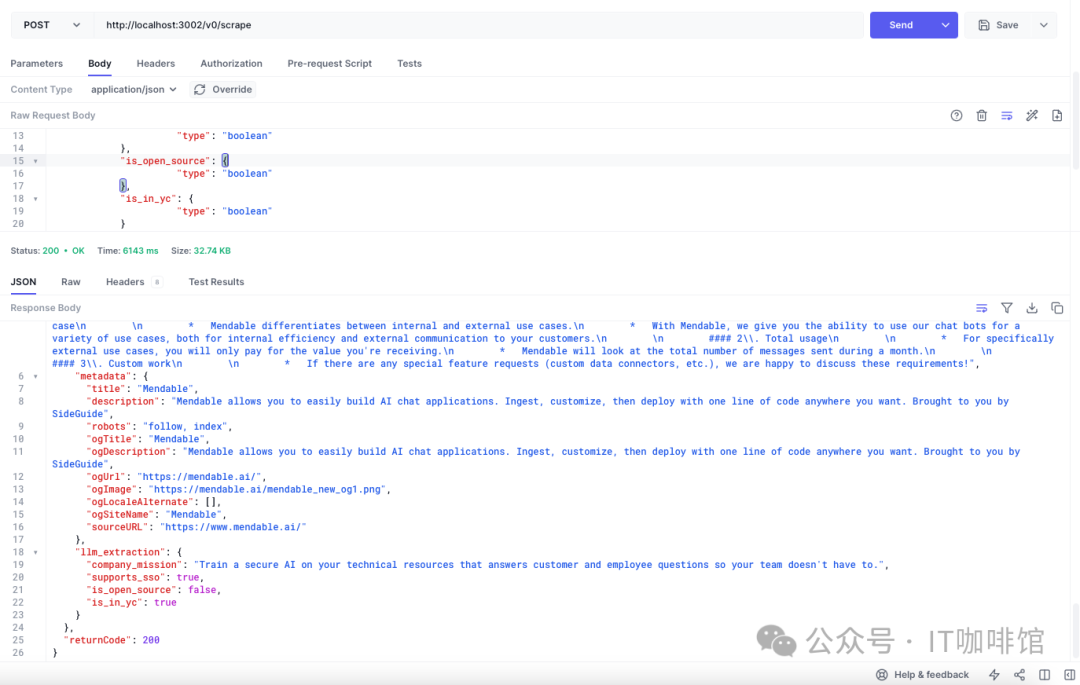

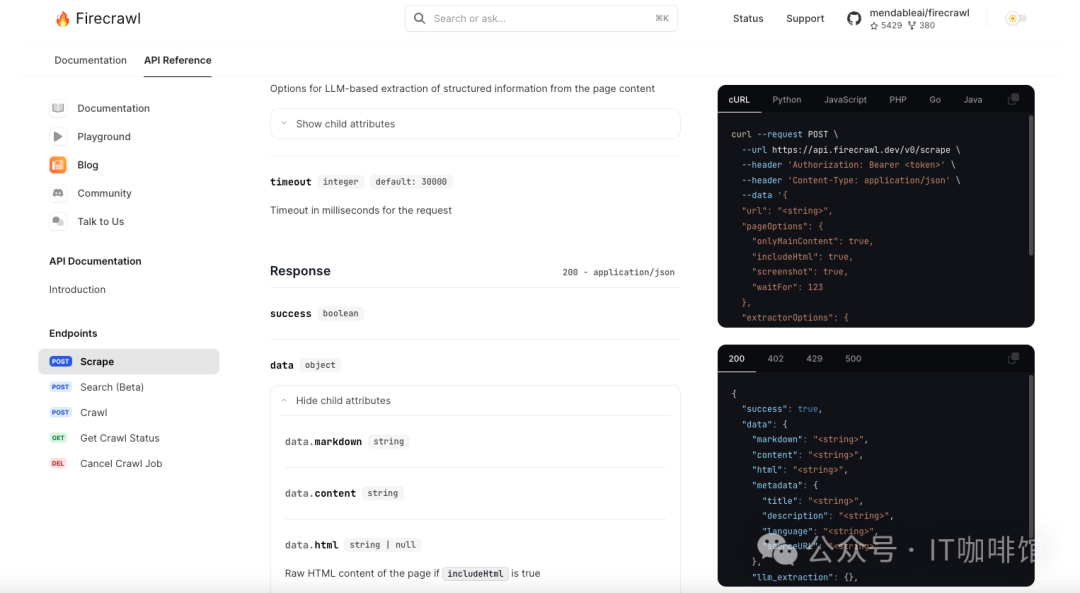

ingFang SC";font-weight: bold;color: rgb(255, 255, 255);line-height: 22px;">使用firecrawl部署好了之后,我们就来详细看下如何使用吧。 首先我们可以通过REST API的方式向firecrawl发送指令,我们首先可以使用 /scrape 这个API来抓取一下他们自己公司的网站,使用如以下curl命令: curl-XPOST<https://api.firecrawl.dev/v0/scrape>\\-H'Content-Type:application/json'\\-d'{"url":"<https://mendable.ai>"}'

当然也可以通过各种API工具来发送,使用体验会更好一些。

除了单个网页的抓取,firecrawl还可以抓取多个页面,使用/crawl API ,您给出要抓取的基本 URL,所有可访问的子页面都将被抓取。 curl-XPOST<https://api.firecrawl.dev/v0/crawl>\\-H'Content-Type:application/json'\\-d'{"url":"<https://mendable.ai>","pageOptions":{"onlyMainContent":true,"includeHtml":true,"screenshot":true,"waitFor":5000},"crawlerOptions":{"includes":["/blog/*","/products/*"],"maxDepth":3,"mode":"fast",}}'

在此示例中,爬虫将完成以下功能: /crawl 不会直接返回结果,发送命令后会返回对应任务的JobID,之后的任务是会在后台执行,可以在前面展示过的管理后台里查看任务的运行情况。

关于API的所有参数选项,可以到文档中查看。

首先 firecrawl 支持对抓取的内容进行大模型提取,利用大模型的能力,直接将抓取结果按预期进行格式化处理。如果想使用这个能力,首先要在.env里配置对应的API KEY。

我们在抓取的命令里,加入extractorOptions,参考如下: "extractorOptions":{"mode":"llm-extraction","extractionPrompt":"Basedontheinformationonthepage,extracttheinformationfromtheschema.","extractionSchema":{"type":"object","properties":{"company_mission":{"type":"string"},"supports_sso":{"type":"boolean"},"is_open_source":{"type":"boolean"},"is_in_yc":{"type":"boolean"}},"required":["company_mission","supports_sso","is_open_source","is_in_yc"]}}

这样再次执行后,可以看到结果的最后就会有提取的内容。

除了这种方式以外,还可以通过代码的方式来使用firecrawl,目前支持 使用代码的方式会有更多的灵活性,可以更加方便的和自己的程序集成起来。下面是一个简单的例子,我用node sdk为例,先要安装: npminstall@mendable/firecrawl-js

然后就可以在代码中使用了 constcrawlUrl='<https://example.com>';constparams={crawlerOptions:{excludes:['blog/'],includes:[],//leaveemptyforallpageslimit:1000,},pageOptions:{onlyMainContent:true}};constwaitUntilDone=true;consttimeout=5;constcrawlResult=awaitapp.crawlUrl(crawlUrl,params,waitUntilDone,timeout);

这里需要说的,默认情况下,官方的SDK中使用的是https://api.firecrawl.dev/ 的在线服务,如果你觉得没问题,那需要去网站上申请API key。 如果你想要使用自己本地启动的服务,那需要自己去修改一下SDK的实现,相关的代码在项目中都开了,大概在这里。

自己把相关内容修改一下,然后自己使用就可以了。

另外还有一些比较不错的玩法,比如使用 firecrawl 的 /search API来信息收集,之后快速转换成LLM-ready的数据。 首先 search的内容大概是这样的。 import FirecrawlApp from '@mendable/firecrawl-js';

//这里的API key根据自己需要了const app = new FirecrawlApp({ apiKey: 'YOUR_API_KEY' });const params = {searchOptions: {limit: 5,},pageOptions: {fetchPageContent: false}};

// Perform a searchconst result = await app.search('What is firecrawl?');

会拿到类似这样一个结果。

剩下就不一步步实现了接下来就简单说下思路: ingFang SC";font-weight: bold;color: rgb(255, 255, 255);line-height: 22px;">总结整体来说firecrawl的可玩性确实非常高,在AI和大模型的时代,给爬虫这个传统工具提供了一个非常有意思的新发展思路。如果你也感兴趣,可以自己动手来玩一玩,还是很有意思的。

|