ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.544px;white-space: normal;background-color: rgb(255, 255, 255);visibility: visible;">人工智能助手ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.544px;white-space: normal;background-color: rgb(255, 255, 255);visibility: visible;">人工智能助手(AI Assistant)是一种利用人工智能技术开发的软件或系统,旨在为用户提供个性化的帮助、信息检索、任务执行、自动化处理等多种服务。这些助手能够理解和响应自然语言指令,学习用户的习惯与偏好,并在各种场景下辅助用户完成复杂或日常的任务。

人工智能助手的核心功能包括但不限于:

1. 自然语言处理:能够识别和理解人类语言,包括文本和语音,从而与用户进行流畅的对话交流。

2. 智能问答:根据用户的问题或请求,从互联网、数据库或内置知识库中检索相关信息,并给出准确的答案或建议。

3. 任务管理:帮助用户管理日程、提醒事项、待办清单等,自动安排优先级,甚至执行一些简单的任务,如发送邮件、设置闹钟等。

4. 个性化推荐:通过分析用户的行为和偏好,提供个性化的内容推荐,如新闻、音乐、电影、购物建议等。

5. 智能家居控制:与智能家居设备连接,允许用户通过语音或手机应用远程控制家中的灯光、温度、安防系统等。

6. 学习与适应:随着使用时间的增长,人工智能助手能够学习用户的习惯、偏好和情绪,不断优化自己的响应和服务质量。

目前,市场上存在多种类型的人工智能助手,如智能手机上的语音助手(如Siri、Google Assistant、小爱同学等)、智能家居中心(如Amazon Echo、Google Home)、以及特定领域的专业助手(如医疗咨询助手、法律文档助手等)。这些助手极大地提高了人们的生活和工作效率,使得人工智能技术更加贴近普通人的生活。

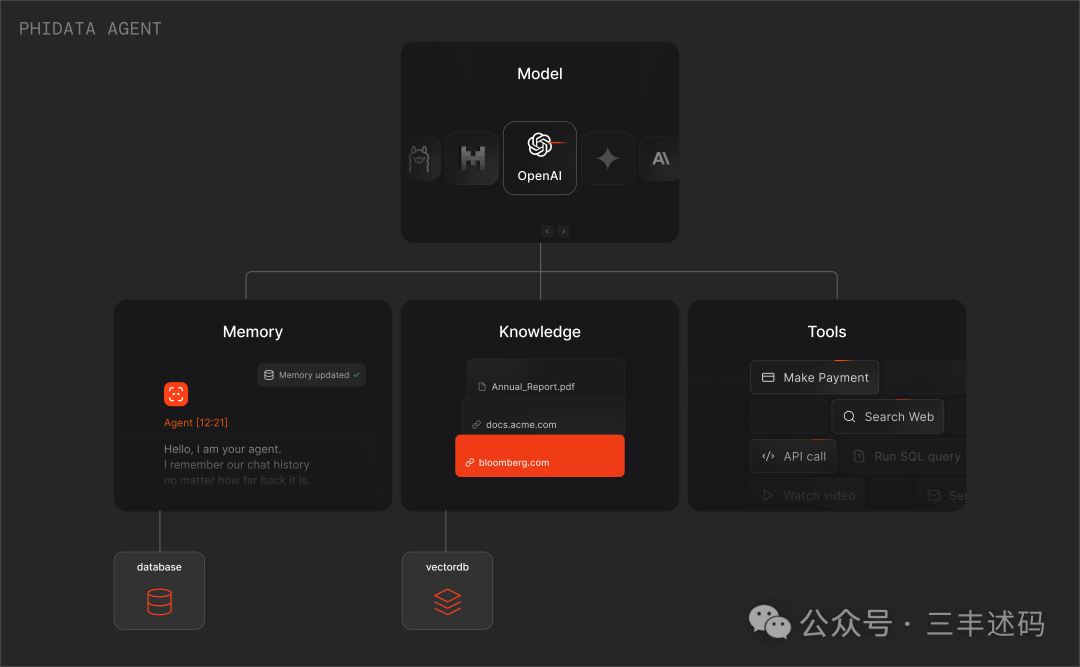

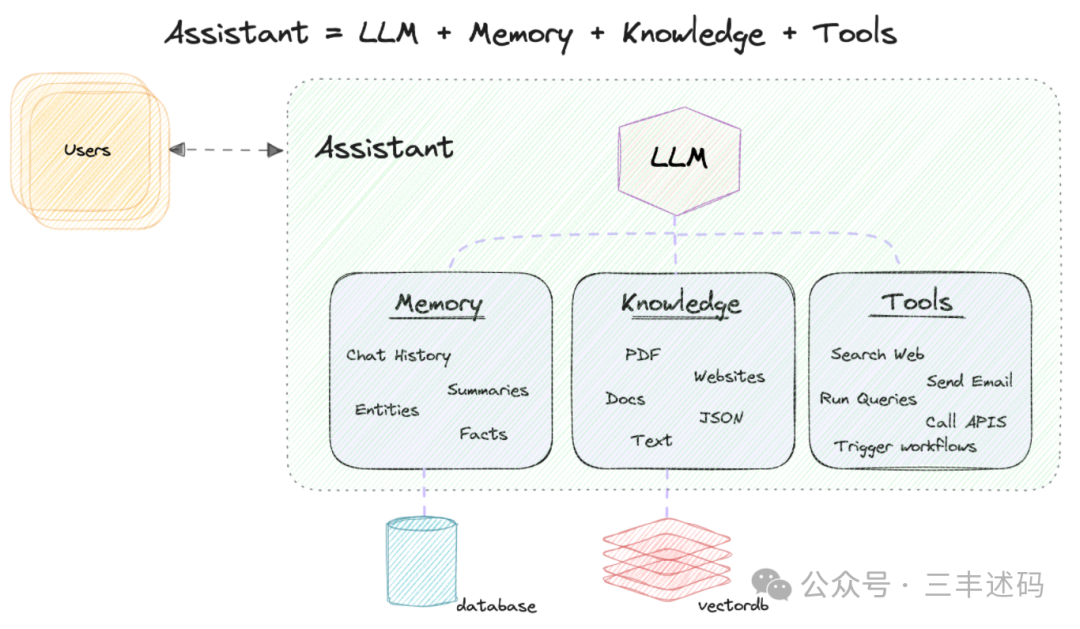

ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.544px;white-space: normal;background-color: rgb(255, 255, 255);visibility: visible;">介绍ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.544px;white-space: normal;background-color: rgb(255, 255, 255);visibility: visible;">在人工智能领域,构建一个能够理解并响应用户需求的智能助手是一项挑战性的任务。PhiData作为一个开源框架,为开发者提供了构建具有长期记忆、丰富知识和强大工具的AI助手的可能性。PhiData的核心优势、应用示例以及如何使用PhiData来构建自己的AI助手。ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.544px;white-space: normal;background-color: rgb(255, 255, 255);visibility: visible;">PhiData的设计理念如下,一个Assistant是以LLM为核心,加上长期记忆(Memory)、知识(结构化、非结构化)和工具(Tools,比如搜索、api调用等),这样就组成了一个完整的Assistant。

ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.544px;white-space: normal;background-color: rgb(255, 255, 255);visibility: visible;">基于这些设计理念,PhiData可以帮助用户方便的构建助手应用,这些助手不仅拥有长期记忆,能够记住与用户的每一次对话,还具备丰富的业务知识和执行各种动作的能力。ingFang SC", "Microsoft YaHei", sans-serif;letter-spacing: normal;text-align: start;white-space: normal;background-color: rgb(255, 255, 255);">应用示例ingFang SC", "Microsoft YaHei", sans-serif;font-size: 16px;letter-spacing: normal;text-align: start;white-space: normal;background-color: rgb(255, 255, 255);">官方提供了一些exampleingFang SC", "Microsoft YaHei", sans-serif;font-size: 16px;letter-spacing: normal;text-align: start;white-space: normal;background-color: rgb(255, 255, 255);" class="list-paddingleft-1">LLM OS: 使用大型语言模型(LLMs)作为核心处理单元来构建一个新兴的操作系统. Autonomous RAG:自主RAG结合检索和生成任务的模型,赋予了LLMs搜索它们的知识库、互联网或聊天记录的能力。 Local RAG:本地RAG利用Ollama和PgVector等技术,使得RAG模型可以完全在本地运行。 Investment Researcher:投资研究员利用Llama3和Groq生成关于股票的投资报告. News Articles: 使用Llama3和Groq撰写新闻文章。 Video Summaries: 使用Llama3和Groq生成YouTube视频的摘要。 Research Assistant: 利用Llama3和Groq帮助研究人员编写研究报告。 ingFang SC", "Microsoft YaHei", sans-serif;letter-spacing: normal;text-align: start;white-space: normal;background-color: rgb(255, 255, 255);">PhiData开发agents#官方仓库的cookbook目录里有一个demo agents程序,使用streamlit开发了交互界面,官方默认是用的open ai的GPT4。我们简单修改,支持groq。

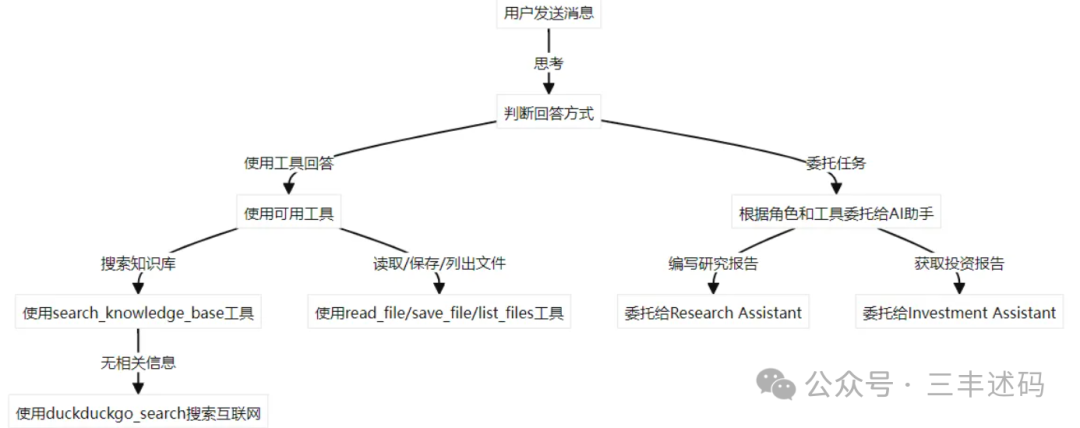

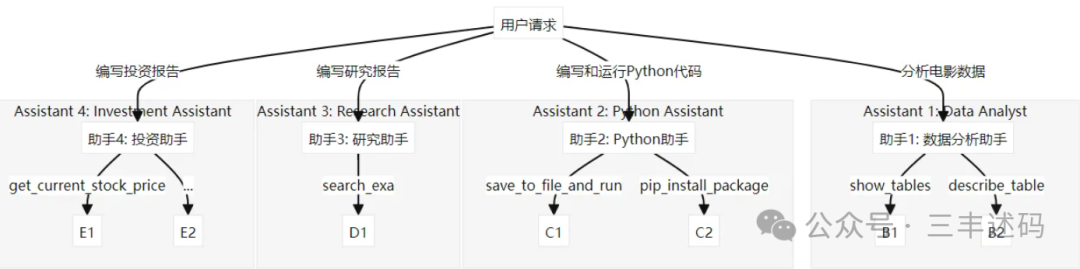

左边支持选择模型,选择Tools与Assistant。我们来一探究竟,这里的tools与Assistant是如何协作的。 运行这个agents,我们从debug信息可以看到prompt。 上面的instructions内容较多,我们抽主要的内容画一个graph图,就方便理解了:

然后针对可以委托的助手,prompt增加了具体的描述,方便LLM去调度,每个助手内部也有各种tools,LLM可以选择合适的

当我们问英伟达最新财报, LLM 识别到需求,选用Investment Assistant助手,然后调用get_investment_report工具 再换个问题,今天法国发生了什么, 这个成功调用了DD搜索。 ============== user ==============DEBUG今天法国发生了什么DEBUGTime to generate response: 6.3184sDEBUG============== assistant ==============DEBUGIt seems there isn't a specific tool that provides the information you're asking for, so here's the answer to your question:

Today's news from France include:

- According to Reuters, trade unions at the French ports of Le Havre and Marseille-Fos have postponed planned strikes initially planned for today and tomorrow. (<https://www.reuters.com/business/retail-consumer/french-port-workers-postpone-strike-action-2023-05-23/>)

- Le Point (French news outlet) reports that police detained 23 people after clashes near a migrant camp on the outskirts of Paris on Monday night. (<https://www.lepoint.fr/societe/immigration/revolte-dans-un-camp-de-migrants-a-paris-01-05-2023-2429234_26.php>)

- French Prime Minister Élisabeth Borne visited the damaged areas of the flooded Aude and Hérault regions. (<https://www.france24.com/fr/france/20230523-les-inondations-en-aude-et-herault-elisabeth-borne-sur-le-terrain-pour-rencontrer-les-sinistres>)

PhiData开发workflow应用#当前像coze、dify这样的产品都支持workflow功能,可以可视化的定义workflow来解决一些相对复杂的问题,而PhiData提供了通过code编排workflow的功能。 PhiData的workflow是可以串联assistant, 比如下面的例子: import jsonimport httpx

from phi.assistant import Assistantfrom phi.llm.groq import Groqfrom phi.workflow import Workflow, Taskfrom phi.utils.log import logger

llm_id: str = "llama3-70b-8192"def get_top_hackernews_stories(num_stories: int = 10) -> str:"""Use this function to get top stories from Hacker News.

Args:num_stories (int): Number of stories to return. Defaults to 10.

Returns:str: JSON string of top stories."""

# Fetch top story IDsresponse = httpx.get("https://hacker-news.firebaseio.com/v0/topstories.json")story_ids = response.json()

# Fetch story detailsstories = []for story_id in story_ids[:num_stories]:story_response = httpx.get(f"https://hacker-news.firebaseio.com/v0/item/{story_id}.json")story = story_response.json()story["username"] = story["by"]stories.append(story)return json.dumps(stories)

def get_user_details(username: str) -> str:"""Use this function to get the details of a Hacker News user using their username.

Args:username (str): Username of the user to get details for.

Returns:str: JSON string of the user details."""

try:logger.info(f"Getting details for user: {username}")user = httpx.get(f"https://hacker-news.firebaseio.com/v0/user/{username}.json").json()user_details = {"id": user.get("user_id"),"karma": user.get("karma"),"about": user.get("about"),"total_items_submitted": len(user.get("submitted", [])),}return json.dumps(user_details)except Exception as e:logger.exception(e)return f"Error getting user details: {e}"

groq = Groq(model=llm_id, api_key="你的API KEY")

hn_top_stories = Assistant(name="HackerNews Top Stories",llm=groq,tools=[get_top_hackernews_stories],show_tool_calls=True,)hn_user_researcher = Assistant(name="HackerNews User Researcher",llm=groq,tools=[get_user_details],show_tool_calls=True,)

writer = Assistant(name="HackerNews Writer",llm=groq,show_tool_calls=False,markdown=True)

hn_workflow = Workflow(llm=groq,name="HackerNews 工作流",tasks=[Task(description="Get top hackernews stories", assistant=hn_top_stories, show_output=False),Task(description="Get information about hackernews users", assistant=hn_user_researcher, show_output=False),Task(description="写一篇有吸引力的介绍文章,用中文输出", assistant=writer),],debug_mode=True,)# 写一篇关于在 HackerNews 上拥有前两个热门故事的用户的报告hn_workflow.print_response("Write a report about the users with the top 2 stories on hackernews", markdown=True)

定义了三个assistant,获取hackernews排行榜,获取文章的作者,生成文章,通过Workflow来实现这三个assistant的编排。 运行结果: ┌──────────┬──────────────────────────────────────────────────────────────────┐││Writeareportabouttheuserswiththetop2storieson││Message│hackernews│├──────────┼──────────────────────────────────────────────────────────────────┤│Response│┌──────────────────────────────────────────────────────────────┐││(17.0s)││**HackerNews知名人物介绍**││││└──────────────────────────────────────────────────────────────┘││││││近日,我们对HackerNews│││的前两名热门故事进行了分析,并对这些故事背后的用户进行了深入挖…│││││││││**排名第一:onhacker**││││││以258分领跑HackerNews排行榜的用户是│││onhacker,他的故事《Windows10│││壁纸原来是真实拍摄的(2015)》引起了大家的关注。onhacker的│││HackerNews账户信息显示,他的karma分数为106,共提交了27│││条内容。他的个人介绍页面上写道:“distributingdistrubutedto│││distrub”,显露出了他幽默的一面。│││││││││**排名第二:richardatlarge**││││││排在第二位的用户是richardatlarge,他的故事《OpenAI并未复制│││ScarlettJohansson的声音,记录显示》获得了102│││分。richardatlarge的HackerNews账户信息显示,他的karma│││分数高达1095,共提交了354│││条内容。他是一名来自美国、现居新西兰的作家,个人介绍页面上留下…│││fromtheUS,livinginNZ”。││││││通过这两位用户的介绍,我们可以看到他们在HackerNews│││社区中的影响力和贡献。他们热衷于分享信息和想法,引发了大家的热…│└──────────┴──────────────────────────────────────────────────────────────────┘ llama3 的中文被弱化了,结果比较一般。 如何构建自己的RAG AI助手 基于Phidata的技术原理和优势,我们可以轻松地构建自己的RAG AI助手。以下是一些建议: 选择合适的预训练模型:选择一个性能优异的预训练模型是构建RAG AI助手的关键。Phidata提供了多种预训练模型供选择,可以根据具体需求选择合适的模型。 引入高效的检索机制:为了提升AI助手的性能,我们需要引入一种高效的检索机制。Phidata的检索机制可以为我们提供有力的支持,使得AI助手能够在需要时快速检索出相关信息。 结合实际应用场景进行优化:在构建RAG AI助手时,我们需要结合实际应用场景进行优化。例如,可以针对特定领域的数据进行训练,提升AI助手在该领域的性能。此外,还可以通过调整模型参数、优化算法等方式来进一步提升AI助手的性能。

总之,Phidata的成功登顶GitHub并非偶然,其背后的技术原理和优势使得RAG AI助手的构建变得简单高效。通过深入了解Phidata的技术原理并结合实际应用场景进行优化,我们可以轻松地构建出具有强大功能的RAG AI助手,为我们的日常生活和工作带来便利

|