|

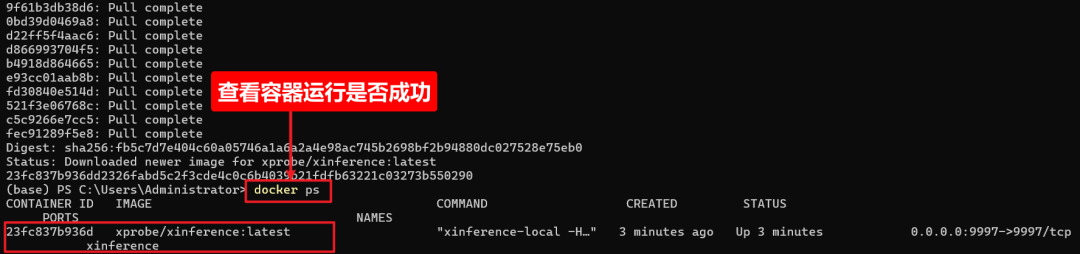

随着大家的深入使用,发现ollama部署大模型虽然方便,但是Dify知识库混合检索,需要有rerank模型,这一点上,ollama是不支持rerank模型的。 因此,部署一个Xinference平台来部署rerank模型的呼声越来越强烈。 ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;color: rgb(63, 63, 63);"> ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;margin: 0.1em auto 0.5em;border-radius: 4px;" title="null"/>ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">于是,我就安排上了这篇部署教程。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;display: table;padding: 0px 1em;color: rgb(63, 63, 63);">一、什么是Xinference?ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">Xinference(全称Xorbits Inference)是一个性能强大且功能全面的分布式推理框架,旨在为各种AI模型的运行和集成提供便捷的解决方案。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">你可以理解为:它是一个超级智能小助手,可以帮你把各种厉害的AI模型轻松部署在本地并运行起来,让它们在你的电脑或者服务器上高效地干活。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;display: table;padding: 0px 1em;color: rgb(63, 63, 63);">二、安装XinferenceingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">请注意:安装xinference需要电脑支持 NVIDIA 的 GPU,否则,后面的步骤无法运行ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;display: table;padding: 0px 0.2em;color: rgb(255, 255, 255);background: rgb(89, 103, 244);">一)打开 powershellingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">按下 win 键,搜索并打开powershell: ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;margin: 0.1em auto 0.5em;border-radius: 4px;" title="null"/>ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">于是,我就安排上了这篇部署教程。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;display: table;padding: 0px 1em;color: rgb(63, 63, 63);">一、什么是Xinference?ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">Xinference(全称Xorbits Inference)是一个性能强大且功能全面的分布式推理框架,旨在为各种AI模型的运行和集成提供便捷的解决方案。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">你可以理解为:它是一个超级智能小助手,可以帮你把各种厉害的AI模型轻松部署在本地并运行起来,让它们在你的电脑或者服务器上高效地干活。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;display: table;padding: 0px 1em;color: rgb(63, 63, 63);">二、安装XinferenceingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">请注意:安装xinference需要电脑支持 NVIDIA 的 GPU,否则,后面的步骤无法运行ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;display: table;padding: 0px 0.2em;color: rgb(255, 255, 255);background: rgb(89, 103, 244);">一)打开 powershellingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 14px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">按下 win 键,搜索并打开powershell: 二)创建容器宿主机目录造打开的powershell中粘贴如下命令,递归创建所需目录: 注意:目录位置可以根据自己电脑情况进行调整,此处默认创建在了C盘根目录,以后xinference的数据都会存在此处 mkdir"C:\xinference"  三)拉取xinference镜像并创建容器还是在打开的powershell中粘贴如下命令,拉取并创建启动xinference容器: 请注意:本步是安装xinference,需要电脑支持 NVIDIA 的 GPU,否则,无法运行,会报如下错误:  & docker run -d `

--name xinference `

-v "C:\xinference:/xinference" `

-e XINFERENCE_HOME="/xinference" `

-p 9997:9997 `

--gpus all `

xprobe/xinference:latest `

xinference-local -H 0.0.0.0 --log-level debug

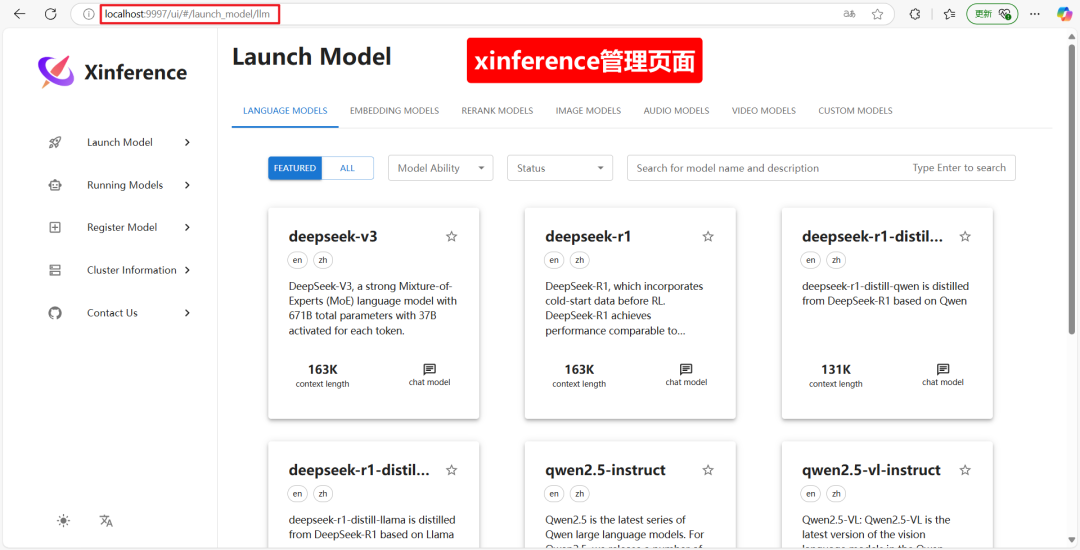

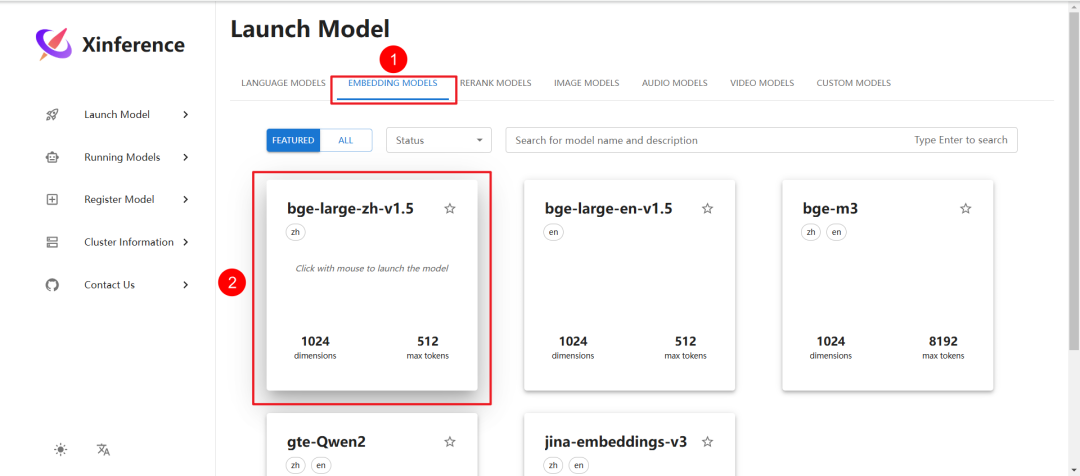

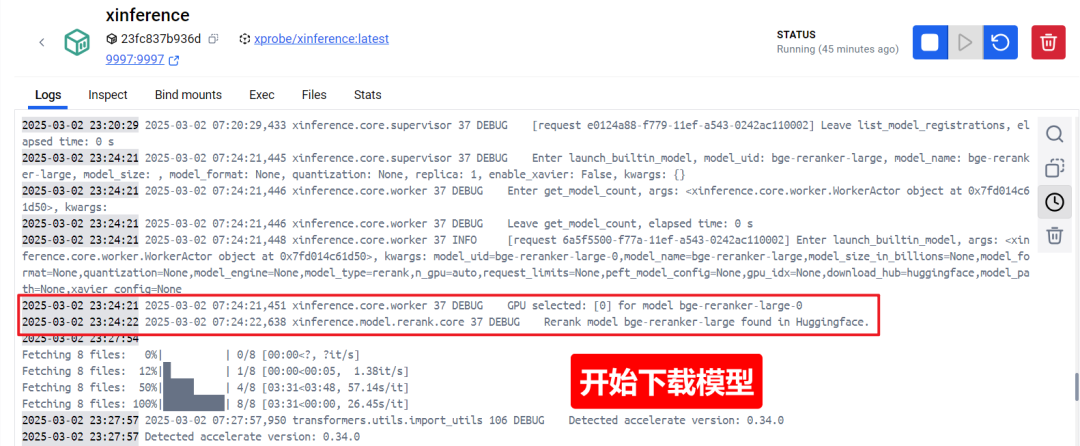

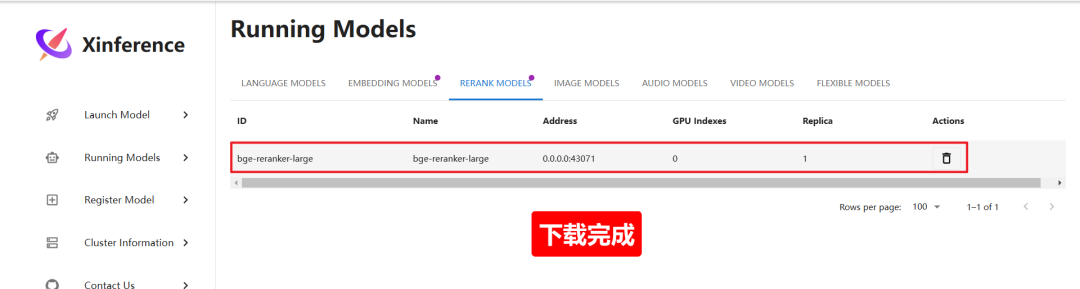

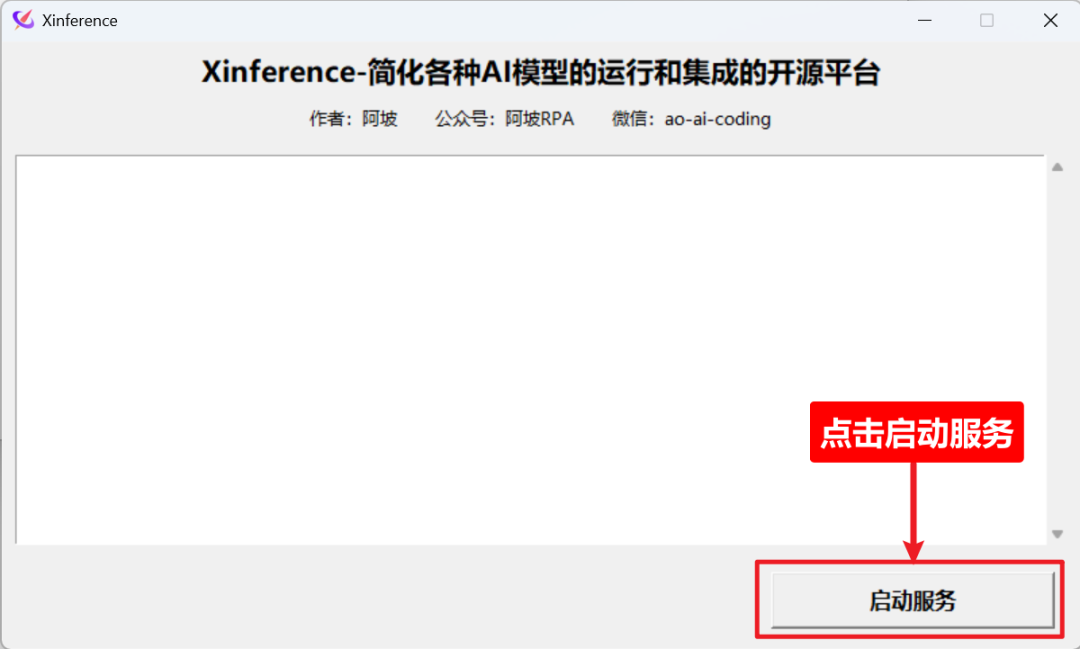

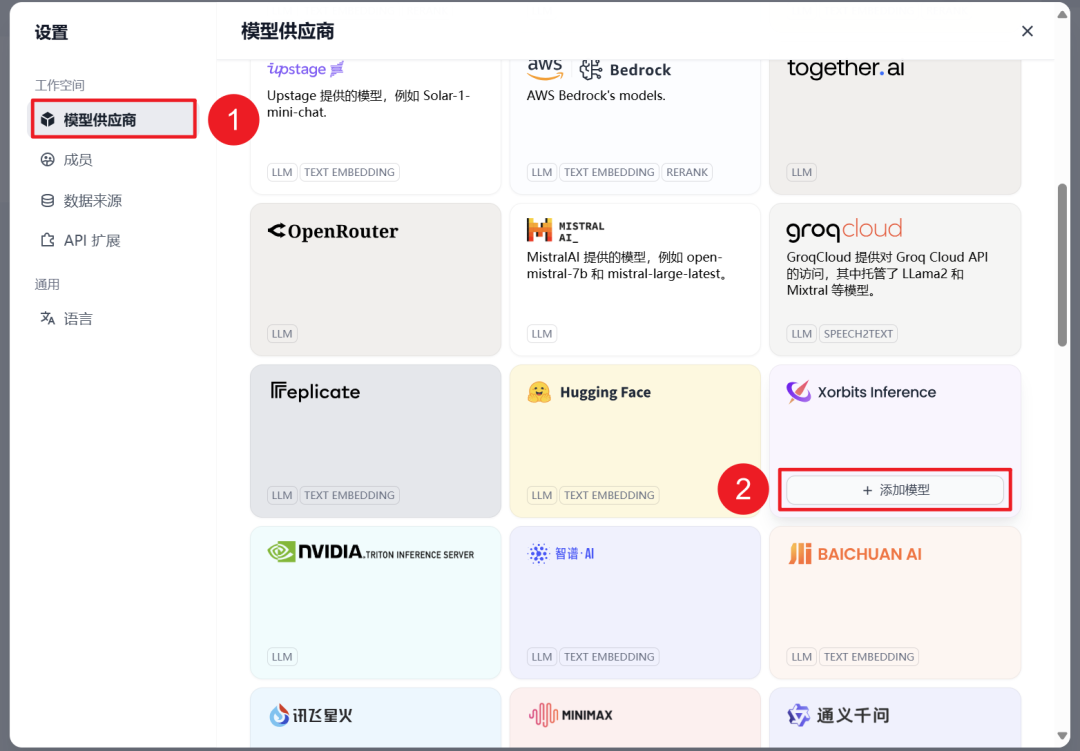

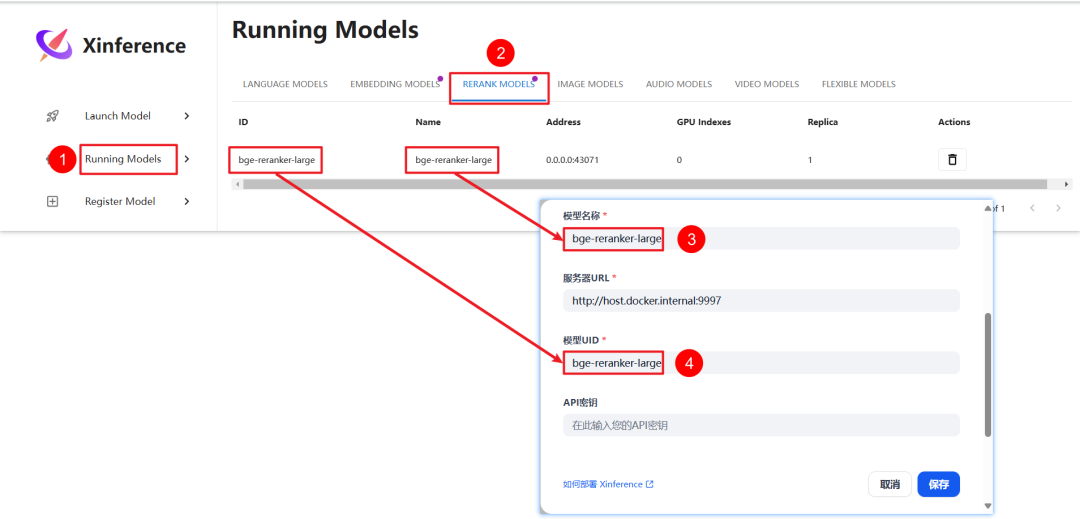

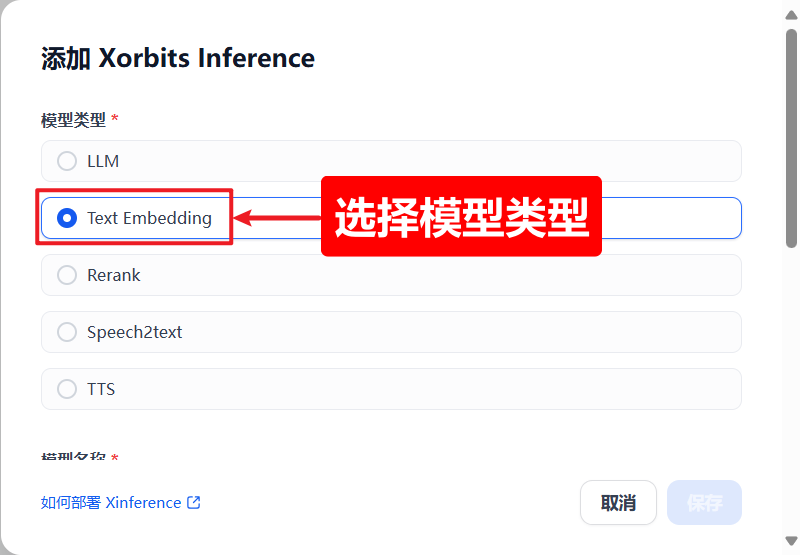

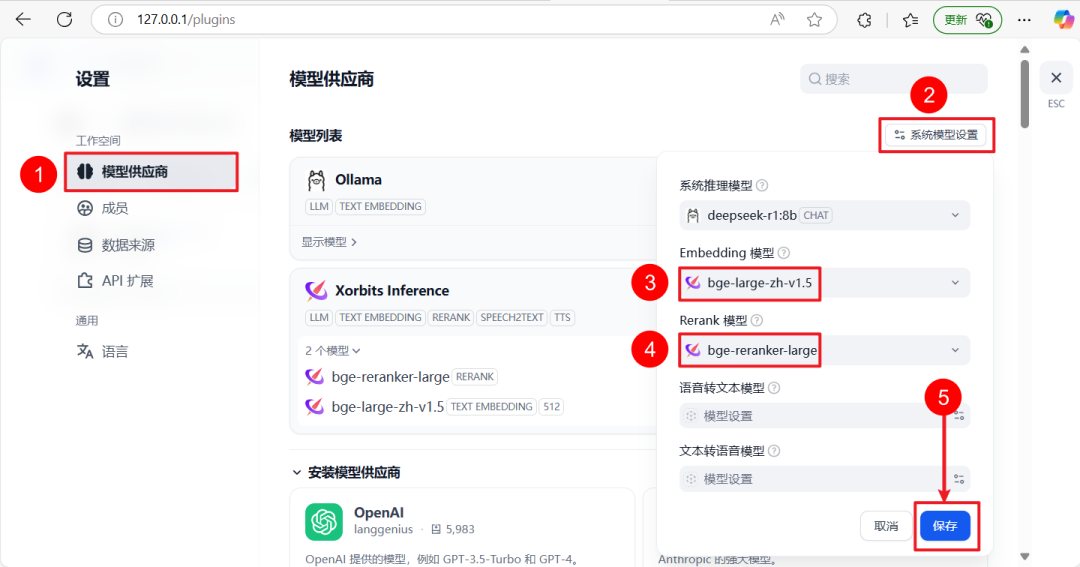

至此,xinference 服务就创建完成并已经启动了,可以访问它的UI界面了 ! 四)访问 Xinference 页面浏览器输入:http://localhost:9997即可访问  三、下载模型此处要从huggingface上下载大模型 ,所以需要科学上网 一)下载embedding模型点击EMBEDDING MODELS,这里我们选择排名比较靠前的bge-large-zh-v1.5   点击部署以后,可以在容器内看到执行下载的信息   二)下载rerank模型切换到RERANK MODELS下面,这里我们依旧选择 beg系列的模型:bge-reranker-large 他对中英文 支持都很不错     四、获取xinference一键安装包如果自己电脑拉取docker镜像总失败,可以考虑下载我封装好的一键安装包。 不需要再去下载docker镜像,只需要点击Xinference.exe即可启动xinference服务,且已经包含离线embedding+rerank模型,无需担心网络问题下载失败 关注公众号:阿坡RPA 回复关键字:xinference 即可获取xinference一键安装包 一)获取下载链接 二)解压缩 三)启动服务 四)等待服务启动完成注意:根据电脑不同,启动时间各不相同,一般在3-5分钟左右,等自动打开浏览器页面,如果打开浏览器页面时,显示无法访问,说明服务还没完全启动,可以再等几分钟,在刷新一下页面即可  五)xinference页面 五、到Dify配置在xinference中安装的模型来到Dify,点击右上角用户头像--》设置--》供应商,安装Xiference插件,用来配置模型  一)安装xinference插件安装插件需要连接dify插件市场,可能需要科学上网,当然,也可以用别人下载好的插件,使用本地离线文件方式安装  二)配置模型主要填写信息: 类型选择,模型名称,模型ID,xinference的服务器URL 其他选项默认 1、配置rerank模型1)选择模型类型 2)填写模型名称和ID等信息此处模型名称和模型UID相同,我们的xinference是在docker容器内的,所以,服务器URL是:http://host.docker.internal:9997  2、配置embedinig模型嵌入模型配置和rerank模型的配置类似 1)选择模型类型 2)填写模型名称和ID等信息 六、Dify系统模型配置embbeding和rerank模型 七、小结本文详细讲述了xinference的部署及与Dify上配置xinference部署好的嵌入模型和rerank模型。

xinference是一个非常强大的平台,他还可以部署很多强大的开源模型,比如:大语言模型,视频生成模型,图片生成模型,音频生成模型等等。大家部署完了以后,可以自己折腾更多的模型,为自己的工作场景提效。

有任何疑问欢迎蔚鑫ao-ai-coding联系我呀~

我是阿坡,叶动(原轻舟)AI工作室联合创始人,专注于AI+RPA自动化提效。2025年是AI大模型应用+AI工作流全面落地的一年,我和明鉴老师,还有叶帮主三人一致致力于AI自动化落地与实战,经过去年在这一方向上的实践与探索,沉淀了丰富的实战经验。

于是,我们三人联合组建2025年度AI陪伴群,带领大家共赴这场AI时代的科技盛宴,每满50人涨价50元,详情请看海报:

去年,我和明鉴老师在平时和学员交流沟通的过程中,经常会遇到,智能体玩的很好的小伙伴,有提效的需求;玩RPA很好的小伙伴,有内容创作的需求。

所以,我们觉得是时候让RPA和智能体来一个合体了!

我敢说,你要是学会了RPA+智能体,分分钟起飞!简直是降维打击! |