|

今天,我们正式推出自研深度思考模型混元T1正式版。

「T1」吐字快、能秒回,还擅长超长文处理,是腾讯自研的强推理模型。

通过大规模强化学习,并结合数学、逻辑推理、科学和代码等理科难题的专项优化,混元T1正式版进一步提升了推理能力。

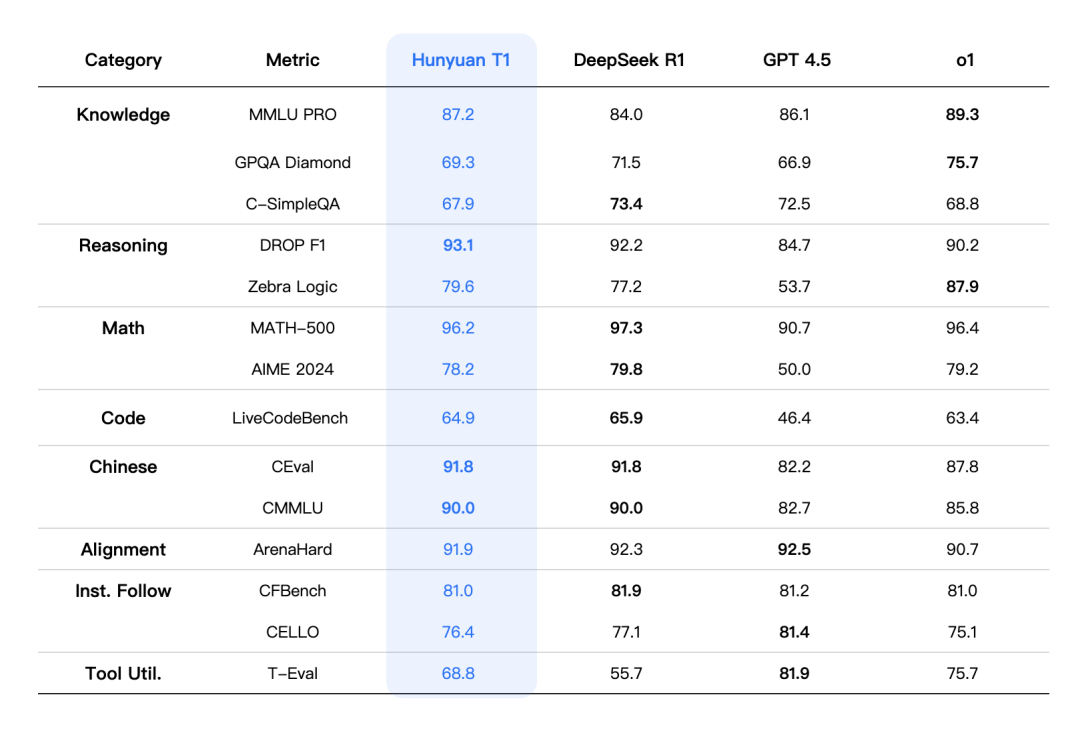

在体现推理模型基础能力的常见benchmark上,如大语言模型评估增强数据集MMLU-PRO中,混元T1取得87.2分,仅次于o1。在CEval、AIME、Zebra Logic等中英文知识及竞赛级数学、逻辑推理的公开基准测试中,混元T1的成绩也达到业界领先推理模型的水平。

「T1」还在多项对齐任务、指令跟随任务和工具利用任务中展现出了非常强的适应性。  ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: var(--articleFontsize);letter-spacing: 0.034em;width: 497.974px;height: 358.173px;" width="497.974"/>注:表格中,其它模型的评测指标来自官方评测结果,官方评测结果中没有的部分来自混元内部评测平台结果 ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: var(--articleFontsize);letter-spacing: 0.034em;width: 497.974px;height: 358.173px;" width="497.974"/>注:表格中,其它模型的评测指标来自官方评测结果,官方评测结果中没有的部分来自混元内部评测平台结果

混元T1正式版沿用了混元Turbo S的创新架构,采用Hybrid-Mamba-Transformer 融合模式。这是工业界首次将混合Mamba架构无损应用于超大型推理模型。

这一架构有效降低了传统Transformer结构的计算复杂度,减少了KV-Cache的内存占用,从而显著降低了训练和推理成本。

基于出色的长文捕捉能力,混元T1能有效解决长文推理中常见的上下文丢失和长距离信息依赖问题。同时,混合Mamba架构针对长序列处理进行了专项优化,通过高效的计算方式,在确保长文本信息捕捉能力的同时大幅降低资源消耗,在相近的激活参数量下,实现了解码速度提升2倍 |