|

ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 1.2em;font-weight: bold;display: table;margin-right: auto;margin-bottom: 1em;margin-left: auto;padding-right: 1em;padding-left: 1em;border-bottom: 2px solid rgb(15, 76, 129);color: rgb(63, 63, 63);">通义千问Qwen2.5开源,媲美Llama3.1-405BingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 1.1em;font-weight: bold;margin-top: 2em;margin-right: 8px;margin-bottom: 0.75em;padding-left: 8px;border-left: 3px solid rgb(15, 76, 129);color: rgb(63, 63, 63);">介绍ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;margin: 1.5em 8px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">就在今天早些时候,阿里发布了新的语言模型Qwen2.5,以及专门针对编程的Qwen2.5-Coder和数学的Qwen2.5-Math模型,包括:ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;padding-left: 1em;list-style: circle;color: rgb(63, 63, 63);" class="list-paddingleft-1"> •Qwen2.5: 0.5B, 1.5B, 3B, 7B, 14B, 32B, 以及72B; •Qwen2.5-Coder: 1.5B, 7B, 以及即将推出的32B; • Qwen2.5-Math: 1.5B, 7B, 以及72B。 ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;margin: 1.5em 8px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">Qwen2.5 所有模型都在最新的大规模数据集上进行了预训练,该数据集包含多达18Ttokens。新模型在指令执行、生成长文本(超过 8K 标记)、理解结构化数据(例如表格)以及生成结构化输出特别是 JSON 方面取得了显著改进。Qwen2.5 模型总体上对各种system prompt更具适应性,增强了角色扮演实现和聊天机器人的条件设置功能。与 Qwen2 类似,Qwen2.5 语言模型支持高达128Ktokens,并能生成最多8Ktokens的内容。它们同样保持了对包括中文、英文、法文、西班牙文、葡萄牙文、德文、意大利文、俄文、日文、韩文、越南文、泰文、阿拉伯文等 29 种以上语言的支持。我们在下表中提供了有关模型的基本信息。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;margin: 1.5em 8px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">专业领域的编程模型Qwen2.5-Coder和数学模型Qwen2.5-Math,相比其前身 CodeQwen1.5 和 Qwen2-Math 有了实质性的改进。具体来说,Qwen2.5-Coder 在包含5.5 Ttokens 编程相关数据上进行了训练,使即使较小的编程专用模型也能在编程评估基准测试中表现出媲美大型语言模型的竞争力。同时,Qwen2.5-Math 支持中文和英文,并整合了多种推理方法,包括CoT(Chain of Thought)、PoT(Program of Thought)和 TIR(Tool-Integrated Reasoning)。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;margin: 1.5em 8px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">以下是整体的模型参数信息介绍:

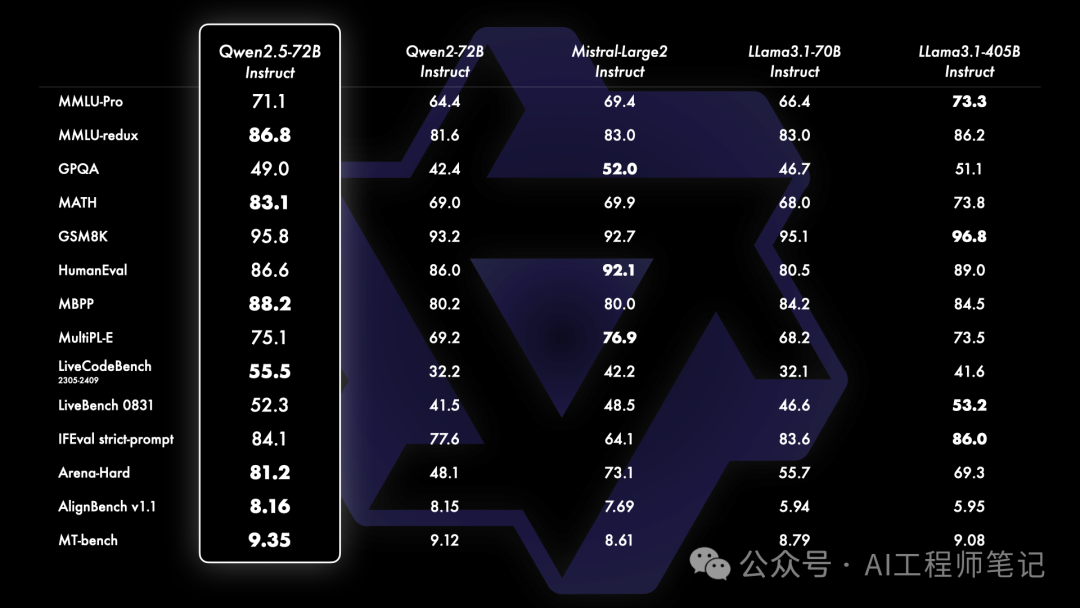

ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;font-size: 1.1em;font-weight: bold;margin-top: 2em;margin-right: 8px;margin-bottom: 0.75em;padding-left: 8px;border-left: 3px solid rgb(15, 76, 129);color: rgb(63, 63, 63);">模型性能ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;margin: 1.5em 8px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">Qwen2.5-72B在多个基准测试中展示了经过指令调优的版本的综合结果,评估了模型的能力和人类偏好。从评测结果可以看到全方位领先Llama3.1-70B,甚至在部分优于Llama3.1-405B。

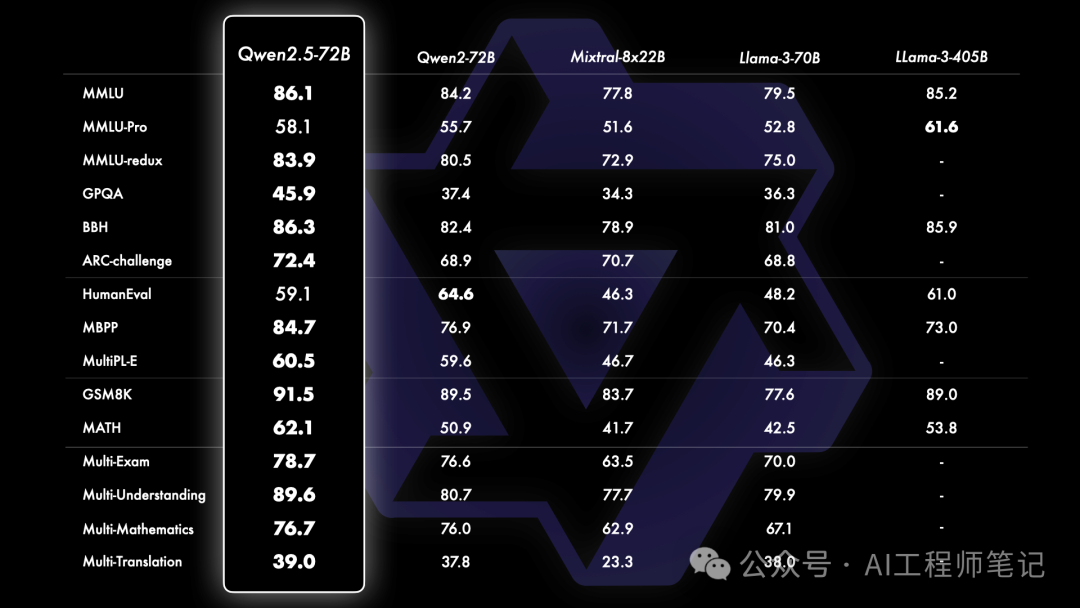

ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;margin: 1.5em 8px;letter-spacing: 0.1em;color: rgb(63, 63, 63);">Qwen2.5-72B的基础语言模型性能达到了顶级水准,同样是在与 Llama-3-405B 这样更大的模型对比时也不落下风。

Qwen2.5重新发布了140 亿参数和 320 亿参数模型,即Qwen2.5-14B和Qwen2.5-32B。两款指令微调模型在多样化的任务中超越了同等规模或更大规模的基线模型,例如 Phi-3.5-MoE-Instruct 和 Gemma2-27B-IT。

Qwen2.5-3B小参数模型仅凭约 30 亿参数就实现了Qwen2-7B、Llama3-8B、MiniCPM3-4B的同等性能,展示了其相对于前辈模型的高效性和能力。

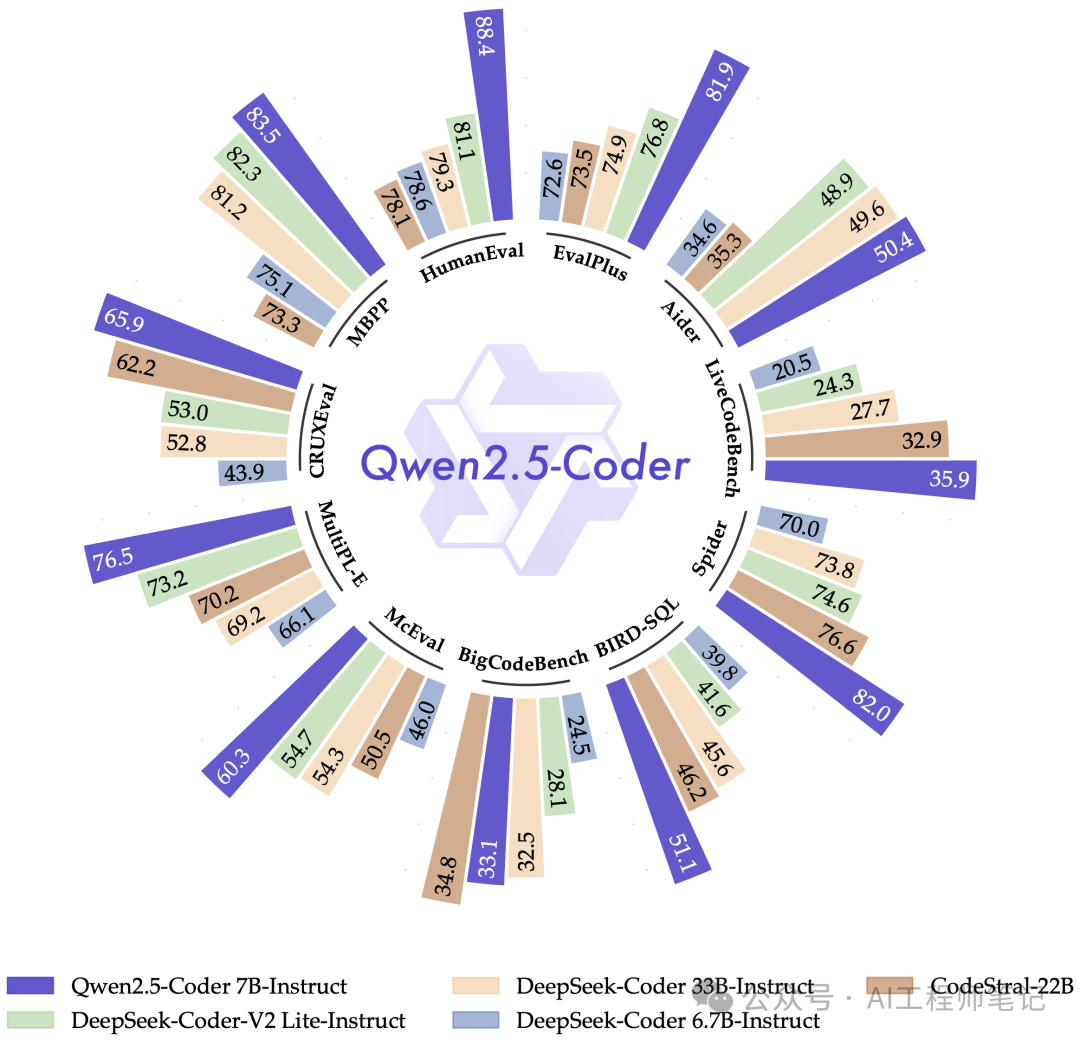

Qwen2.5-Coder编程模型的性能也基本全方位领先于其他模型,如DeepSeek-Coder 33B-Instruct和CodeStral-22B。

Qwen2.5-Math相比于上个月刚刚发布的 Qwen2-Math,在更大规模的数学相关数据上进行了预训练,并且增加了对中文的支持,并通过赋予其进行 CoT(Chain of Thought)、PoT(Program of Thought)和 TIR(Tool-Integrated Reasoning)的能力来加强其推理能力。Qwen2.5-Math-72B-Instruct 的整体性能超越了 Qwen2-Math-72B-Instruct 和 GPT4-o,甚至是非常小的专业模型如 Qwen2.5-Math-1.5B-Instruct 也能在与大型语言模型的竞争中取得高度竞争力的表现。

支持框架•Finetuning:ChatLearn,Llama-Factory,Axolotl,Firefly,Swift,XTuner,Unsloth,Liger Kernel •Quantization:AutoGPTQ,AutoAWQ,Neural Compressor •Deployment:vLLM,SGL,SkyPilot,TensorRT-LLM,OpenVino,TGI •API Platforms:Together,Fireworks,OpenRouter •Local Run:MLX,Llama.cpp,Ollama,LM Studio,Jan •Agent and RAG Frameworks ify,LlamaIndex,CrewAI ify,LlamaIndex,CrewAI •Evaluation MSys,OpenCompass,Open LLM Leaderboard MSys,OpenCompass,Open LLM Leaderboard •Model Training:Arcee AI,Sailor,Dolphin,Openbuddy

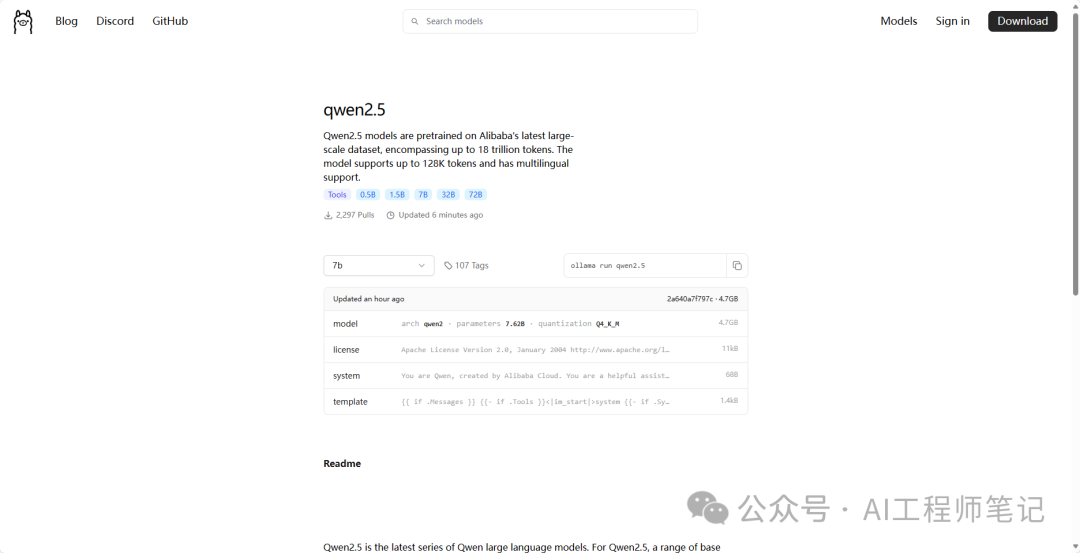

昨天发布的最新版的ollama-0.3.11已支持Qwen2.5

参考 https://qwenlm.github.io/zh/blog/qwen2.5/ |