一台小盒子,为何引发围观

沙龙现场并不张扬。

没有炫目的舞台布景,也没有大型展板。

几台黑色的小主机静静放在桌子上,看上去和市面常见的迷你PC 并无二致。

直到AMD 工程师点开演示画面,屏幕上赫然出现了 GPT-OSS-120B 的运行界面。

动辄百亿、千亿参数的模型,在这样一台台“小盒子”上跑了起来。

会场安静了几秒。随后,有人举起手机拍照,有记者低声和同伴确认:“这东西真能跑起来?”

在绝大多数人的认知里,千亿级模型的门槛就是“服务器”。

动辄几十万元,体积庞大、功耗惊人,还得配备专业的机房、电源与运维团队。

AMD 却拿出了一台台售价不到两万的小型工作站,把这个场景搬回了桌面。

这种“反差感”,在一个被“显存焦虑”困扰了一整年的行业里,格外让人震撼。

显存焦虑,终于有人给出答案

如果给2025 年的 AI 行业做一份年度热词榜,“Agent” 和 “显存” 必然高居前列。

模型的参数量不断膨胀,从7B 到 30B,再到 100B+;

场景的复杂度也在升级,从单一的文生文,到跨模态输入,再到多个Agent 串联完成复杂任务。

所有这些进展,都在吞噬显存。

但现实极其残酷:

消费级显卡,大多停留在24GB;

商用显卡,顶多也就是32GB;

真要跑千亿级模型?直接超纲。

这就像是一条“算力分水岭”。

谁能跨过去,谁就有机会进入Agent 的下一阶段;

谁跨不过去,就只能望而兴叹。

这便是所谓的“显存焦虑”。

开发者知道AI Agent 的潜力,却发现手里的硬件无法承载。

企业想要试水,却发现成本高得难以承受。

科研机构更清楚模型的价值,却往往被资源限制绑住了手脚。

纪朝晖(AMD 大中华区市场营销副总裁)在现场点明了这一点:

“今天一张普通显卡跑不了千亿模型,但395 能。”

他的话让在场的媒体人频频点头。

因为在这个节点,不仅能跑,而且还要跑得快!MoE架构的千亿参数模型如GPT-OSS-120B在这些mini AI 工作站上也能跑到40个tokens每秒的推理速度!。

云算力不是万能解药

那么问题来了:如果本地跑不动,为什么不去用云呢?

过去两年,云GPU 租赁几乎成了创业公司和科研机构的“标配”。A100、H100 被炒成算力短缺时代的「硬通货」,谁掌握了算力,谁就掌握了研发主动权。

但真正在云上跑过大模型的人都知道:云并没有解决根本问题,反而暴露出三大局限。

1. 成本过高,难以长期承受

算一笔简单的账:

对于需要反复迭代的中小团队,这几乎是不可承受之重。很多团队并不是不想做实验,而是被价格劝退。

2. 调度不稳,供需缺口明显

云GPU 的另一个痛点是“抢”。

在学术大赛、热门benchmark 节点,经常出现排队数小时的情况。甚至有人遇到过模型跑到一半,云资源被系统强制回收,前功尽弃。

科研和开发需要稳定的环境,但云的波动性让实验随时可能被打断。对很多初创公司来说,这种不确定性几乎是致命的。

3. 数据约束,合规与安全的双重难题

AI 正快速进入垂直行业,而这些行业的数据天然敏感:

很多企业CTO 在评估云方案时,都被法务和合规部门反复拦下。

所以,云GPU 不是“不行”,而是代价太大。

成本、稳定性、数据安全三座大山,正在逼着行业追问:有没有可能把百亿模型跑在本地?

这不是一个噱头,而是出于安全、成本、效率三重考量的必然需求。

395 的出现,正是这一追问的具象化回应。

一台“小怪兽”,真能跑千亿模型

那么,锐龙AI Max+395 到底凭什么?

它的秘密武器很直白:96GB独享显存。

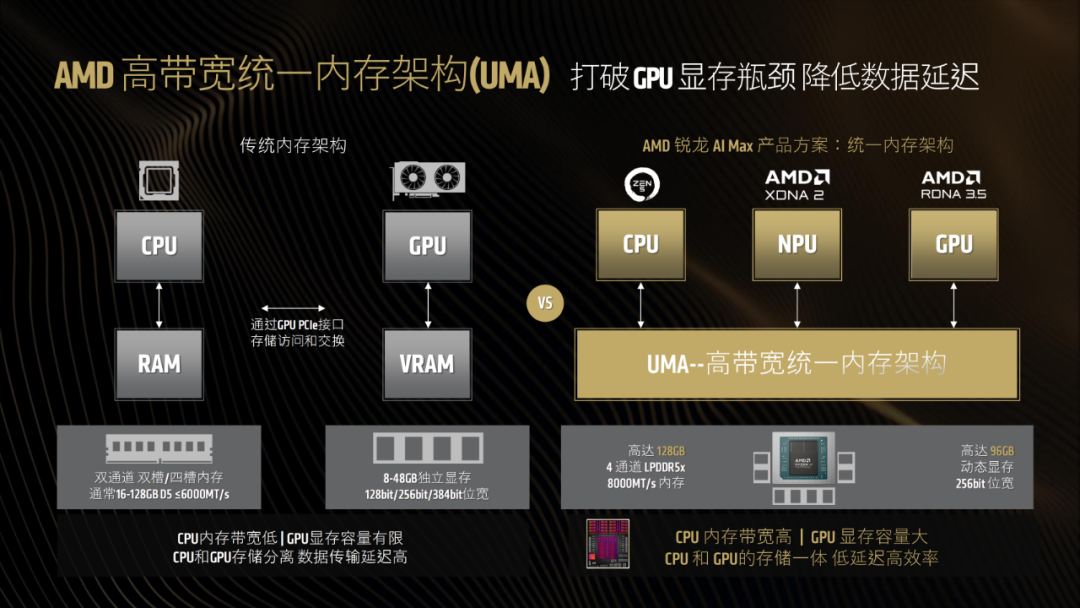

这并不是单纯把大容量内存堆上去,而是通过AMD统一内存架构(UMA)技术,把128GB 系统内存灵活分配给 CPU、GPU、NPU 使用。

其中,96GB 可专供显卡。

这里的CPU 是创新的Zen 5 架构,16 核 32 线程、主频高达5.1GHz,本来只会出现在顶级游戏本上;GPU 拥有 40CU,相当于 4060/4070 级别独显的性能;再加上 50+ TOPS 的 NPU,完全符合 Windows 11 AI+PC 标准。

换句话说,它等效于一张4060/4070 级别的独立显卡,却带着服务器级别的显存空间。

这一点在本地大模型部署时尤为关键。

传统显卡常见的“瓶颈”在于:算力够了,显存却不够。

结果就是:模型放不下,跑不起来。

锐龙AIMax+ 395 通过 UMA技术打破了这道“物理门槛”:

ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.034em;background-color: transparent;">

ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.034em;background-color: transparent;">

ingFang SC", system-ui, -apple-system, BlinkMacSystemFont, "Helvetica Neue", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.034em;background-color: transparent;">大模型能装下:千亿参数不再是服务器专属;

在演示中,根据实际估算及模型官方文档,AMD 给出了几组显存占用数据:

Qwen3-30B:需要18GB 就能跑,轻松通过。

Llama4-109B:需要66GB 显存跑通。

Mistral Large 123B:需要68GB 显存。

GPT-OSS-120B:需要80GB 显存,实测达到了40+ Tok/s。

这些模型的共同点是:虽不是“671B”那样的庞然大物,但也都是百亿乃至一千亿级里极具可用性的“黄金模型”。

科研需要它们,企业项目需要它们,开发者更想在本地复现实验。

而此前,24GB/32GB 显卡完全无力触碰。

一句话:395 把服务器才能玩的“大模型实验”,搬回了桌面。

它不是PC,也不是服务器

为什么AMD 要把它叫做“Mini AI 工作站”?

纪朝晖在现场说了一句掷地有声的话:

“希望它能像互联网时代的树莓派一样,成为AI 时代的普及推动者。”

这并不是一句简单的营销口号。

树莓派在互联网时代的意义,从来不是性能,而是普及与可玩。

它把计算带进了每一个极客的书桌,让数以百万计的人第一次真正有机会“动手试一试”。

锐龙AI Max+395 延续的正是这种逻辑:

换句话说,它不是替代机房,而是让算力下沉到更接近用户的地方。

纪朝晖的另一句话也很关键:

“Windows11AI+PC 已经让每个员工人手一个 AI 助手;

下一步,就是Mini AI 工作站,让团队、小企业、超级个体都有属于自己的 Agent 引擎。”

这既是对锐龙AI MAX+395 的定位,也是对市场未来的判断。

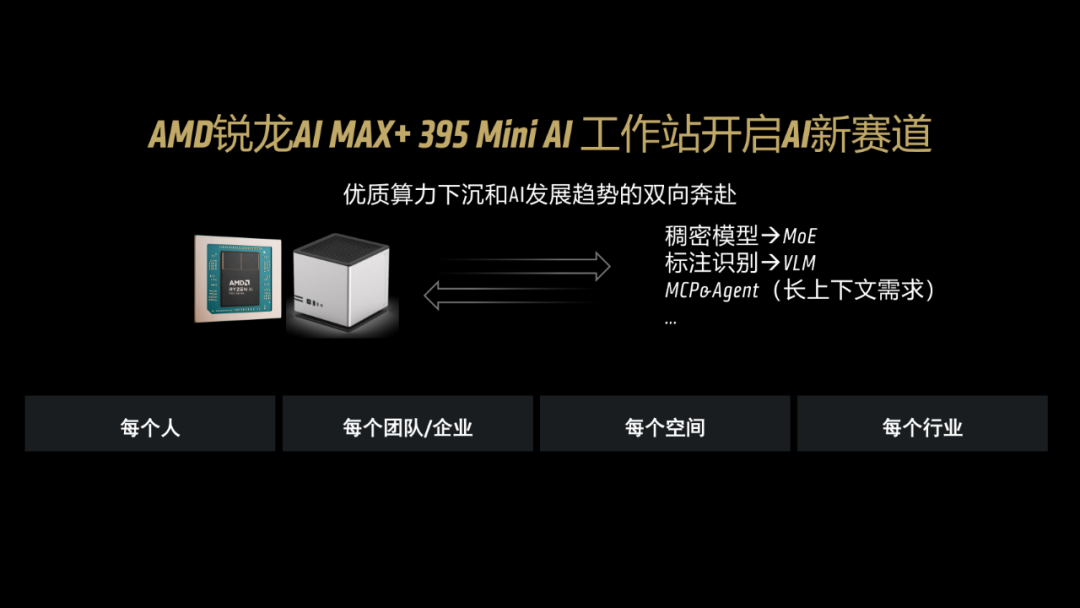

Agent 元十年,需要这样的机器

2025 年被业界称为“AI Agent 元年”。

但正如Karpathy 泼过的冷水:“真正成熟要十年。”

这意味着,我们刚刚进入的是一个“元十年”:未来十年,Agent 的每一步成长,都离不开可靠的本地算力。

Lisa Su 博士在公开发言中,曾经把 AI 定义为:

“过去 50 年里最重要的技术变革”

她强调,未来几十年的科技创新将高度围绕AI 展开。

从科研突破到企业流程重构,从教育到娱乐,AI 会成为每个行业的基础设施。

在这样的背景下,Agent 并不是一个可有可无的附加功能,而是下一代生产力的入口。

但是:

云端Agent 面临数据安全与合规挑战,尤其是涉及知识产权和隐私的场景;

动辄几十万的AI 一体机服务器,中小企业与开发者根本负担不起;

小模型虽便宜,却撑不起复杂任务,更无法满足长上下文和多Agent 协作。

因此,市场确实缺少一个新的定位:既能跑千亿参数模型,又足够便宜好用。

锐龙AI Max+395 恰好踩在了这个关键点上。

场景里的锐龙AI MAX+395,比参数更有说服力

硬件规格永远冰冷。

真正让人信服的,是它能不能跑起来、能不能进到真实场景。

在沙龙现场,AMD 与合作伙伴一起展示了几个典型Demo:

1. 个人开发者

过去写Demo,需要会代码。

现在借助锐龙AIMAX+ 395,哪怕是没有编程经验的朋友,也能在LM Studio作为本地大模型平台,为N8N自动化工作流工具提供大模型API调用,做出一键分析B 站数据的“小助手”。

或者快速用AI协助制作真实工作需要的便利小工具如KPI 检查工具:输入表格,选择对应的时间和活动,工具帮你核查逻辑合理性,输出结论。

2. 小企业

一家制造公司,把几千个零件的BOM 批量分析交给 395 上的大模型。

以前人工检查,出错就是灾难;现在AI 不仅快,还精准。

HR 场景同样现实:1000 份简历,AI 先筛一遍,再把合适的推给面试官。

3. 社区/物业

某物业服务的公开区域摄像视频流数据,以前需要昂贵的服务器来处理抽帧、识别、报警。

借助395 可以多模并行:YOLO 做目标检测,VLM 做场景分析,ML 算法做预测。火情、入侵、电瓶车过热,甚至垃圾溢满,都能实时告警。

算力从“机房”下沉到“小盒子”,成本直接砍掉一多半。

4. 家庭

孩子踢被子、冰箱物品不足、家庭相册智能检索。

这些过去依赖云端的“智能家居幻想”,如今能在本地落地。

而且数据留在家里,不必担心隐私泄露。

5. 会议室

会议是最典型的长上下文场景。

395 能处理 100K+ 上下文,配合 MCP,做会议纪要、跨语种翻译、代办任务分配。

过去靠秘书,现在靠Agent。

这些场景,展示了395 从“个人到团队,从社区到家庭”的广阔适用性。

比起参数,这些故事更有说服力。

纪朝晖也在现场强调:

“今天市场上确实缺少一个合适的平台。我们希望395 成为那个解决方案。”

八家厂商押注,生态开始发芽

锐龙AIMAX+ 395 并不是孤军作战。

在7月的Mini AI工作站行业解决方案峰会上,AMD携合作伙伴展出了超过20款的AMD锐龙 AI Max+395 Mini AI工作站产品。

在这场媒体沙龙上,就有八家合作厂商同台亮相,展示了搭载锐龙AI Max+ 395 的多样化产品:

Abee:AIStation395Max

惠普:Z2MiniG1a

希未:AideaStationR1

零刻:GTR9Pro

首届玲珑:六联智能AXB35-02-H02-BQ

极摩客:EVO-X2

天钡:NEX395

铭凡:MS-S1Max

在生态层面,Ripple AI、魔搭社区、Wisemodel 等伙伴则更强调软件与社区:

“AI 的普及,不只是卖硬件,更要让开发者、学生、小企业有工具可用,有社区可依赖。”

这种打法和树莓派当年的路子如出一辙:硬件、软件、社区三位一体,推动生态滚雪球式成长。

品牌野心:从苏妈到全栈AI

如果把这次沙龙只看成一场产品秀,那就低估了AMD 的野心。

过去几年,AMD 的品牌势能正在快速上升:

过去四年,AMD品牌价值提升了8 倍;

Lisa Su 博士去年被《时代》杂志评为年度CEO;

今年,她又在《财富》全球商业领袖榜排名第14 位;

在BrandZ 最新全球最有价值品牌榜中,AMD 已经跻身前50,排名第47。

这意味着,AMD 已经不再是过去那个被视为“挑战者”的角色,而是在逐渐塑造 AI 时代的领导者心智。

Lisa Su 在多个公开场合都明确表示:

“AI 是过去 50 年里最重要的技术变革,甚至超过互联网的诞生。”

在她的带领下,AMD 构建的 AI 版图覆盖了从数据中心到边缘再到终端的完整链路。今天又通过mini AI 工作站覆盖端侧、边缘侧,打通AI Agent赋能实体应用的最后一公里。

而锐龙AI Max+ 395,就是这条战略链路里最贴近用户的那一环。

它的意义不只在于一台机器,更在于心智:告诉市场,AMD 不只是芯片供应商,而是在为AI Agent 元十年铺设地基。

未来的可能性

纪朝晖在现场总结时说:

“今天一张普通显卡跑不了千亿模型,但395 能。我们希望它成为团队、部门、小企业的 AI 引擎。”

这句话,道出了395 的定位——它是算力下沉的拐点。

如果说Windows 11 AI+PC让AI 助手走进了每个员工的桌面,那么Mini AI 工作站的意义,就是把Agent 引擎交到团队、小企业、超级个体的手里。

它既不像服务器那样昂贵,也不像普通PC 那样捉襟见肘,而是恰好踩在了那个“空白带”。

未来,我们或许会看到:

学生在课堂上用395 学习 AI 原型开发,成为真正的 AI 原生人才;

开发者在家里用395 搭建工作流,不再依赖昂贵的云服务;

小企业用395 承载内部 Agent 系统,从简历筛选到业务数据分析;

家庭用395 做智能中枢,把安全、健康、生活的琐事交给本地 AI;

一人公司借助395,跑起百万级任务,构建属于自己的业务引擎。

所有这些场景的背后,是一个共同的逻辑:算力普惠。

这场没有大屏幕、没有灯光秀的沙龙,留下的最大记忆点,不是热闹,而是冷静的冲击感。

当GPT-OSS-120B 在一台不到两万块的小主机上跑起来时,所有在场的人都明白:某些东西真的变了。

纪朝晖说过一句话:

“AI Agent 元十年不会等人,但 AMD 希望把门槛降下来,让更多人能参与其中。”

锐龙AI Max+ 395 也许不是最强大的机器,但它极有可能是最“及时”的那台。

AI Agent 的大幕正在拉开,而AMD 用一台小怪兽,把未来推到了我们眼前。

- END -