|

ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;padding: 1em;border-radius: 8px;color: rgba(0, 0, 0, 0.5);background: rgb(247, 247, 247);"> 能做的实在太多了

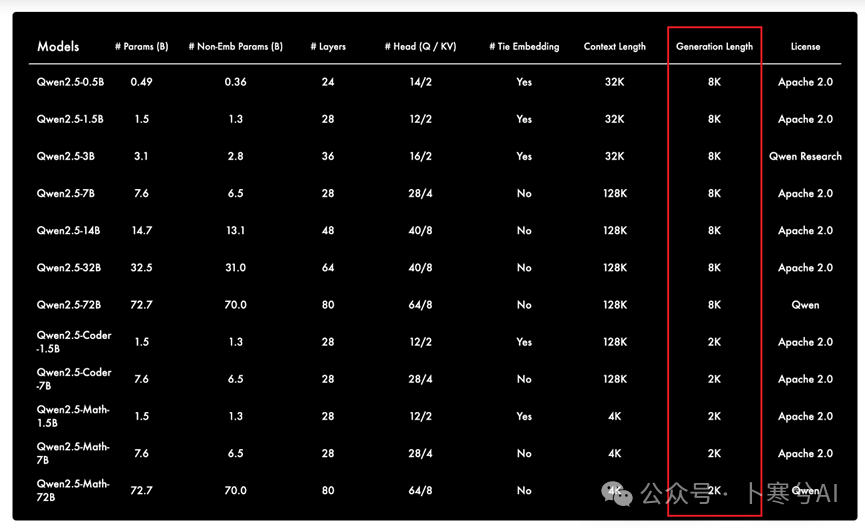

ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;color: rgb(63, 63, 63);">ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">Qwen系列开源模型的受关注程度一直比较高,不光国内,国外也有大量用户。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">上周就看到不少人开始预告Qwen2.5。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;color: rgb(63, 63, 63);"> ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">果然它现在就来了,而且还是超级“全家桶”。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">我已经试第一时间测试并使用了,感觉效果非常不错,详细可翻到后面看实测效果。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">在这之前还是先帮大家总结一下Qwen2.5的关键信息。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;padding-left: 8px;color: rgb(63, 63, 63);">TL; DR: ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">果然它现在就来了,而且还是超级“全家桶”。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">我已经试第一时间测试并使用了,感觉效果非常不错,详细可翻到后面看实测效果。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;letter-spacing: 0.1em;color: rgb(63, 63, 63);">在这之前还是先帮大家总结一下Qwen2.5的关键信息。ingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;padding-left: 8px;color: rgb(63, 63, 63);">TL; DR:• Qwen 2.5系列包括基座语言模型和针对编程的Qwen2.5-Coder,以及针对数学的Qwen2.5-Math。每种都包括多个尺寸,具体地, •Qwen2.5: 0.5B, 1.5B, 3B, 7B, 14B, 32B, 72B; •Qwen2.5-Coder: 1.5B, 7B, 32B(即将推出); •Qwen2.5-Math: 1.5B, 7B, 72B。

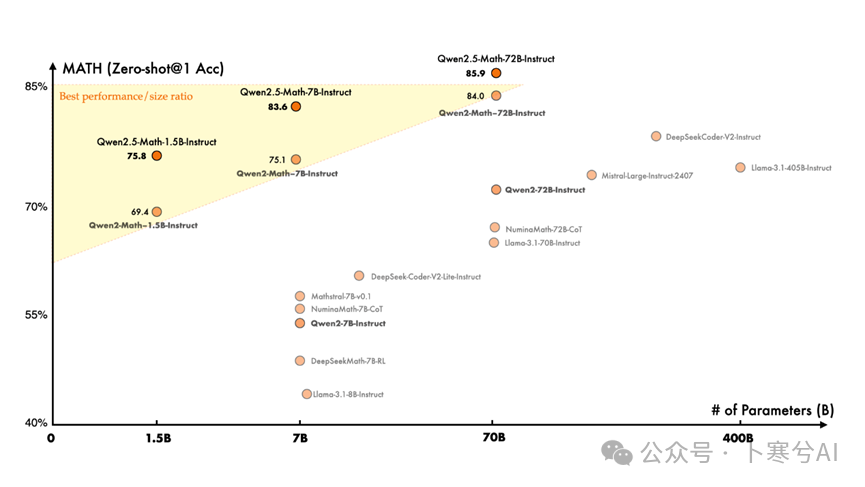

• 每个模型除了默认的BF16精度版本,还提供量化版本,比如Int4/8,GPTQ、AWQ 和 GGUF。 •训练集规模: • 主要能力提升: • 知识储备(MMLU: 85+) • 编程能力 (HumanEval: 85+) • 数学能力 (MATH: 80+)

• 其他改进: • Qwen2.5上下文窗口128K tokens,生成长度最多 8K tokens • 指路:

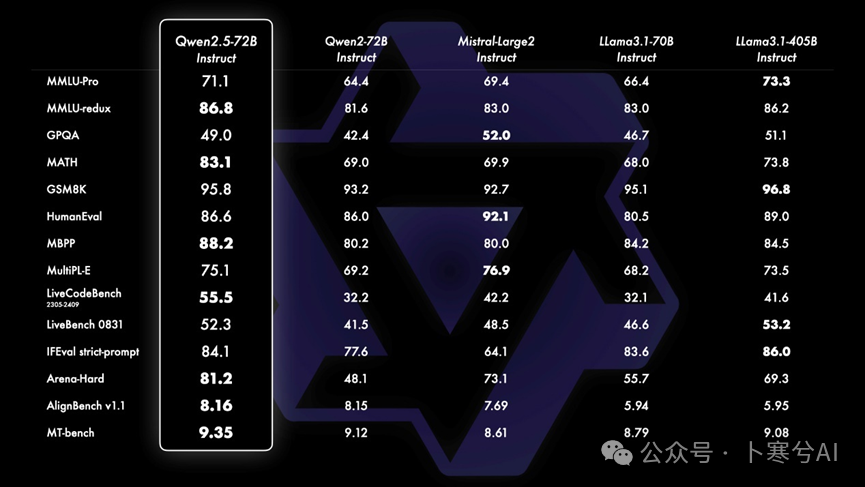

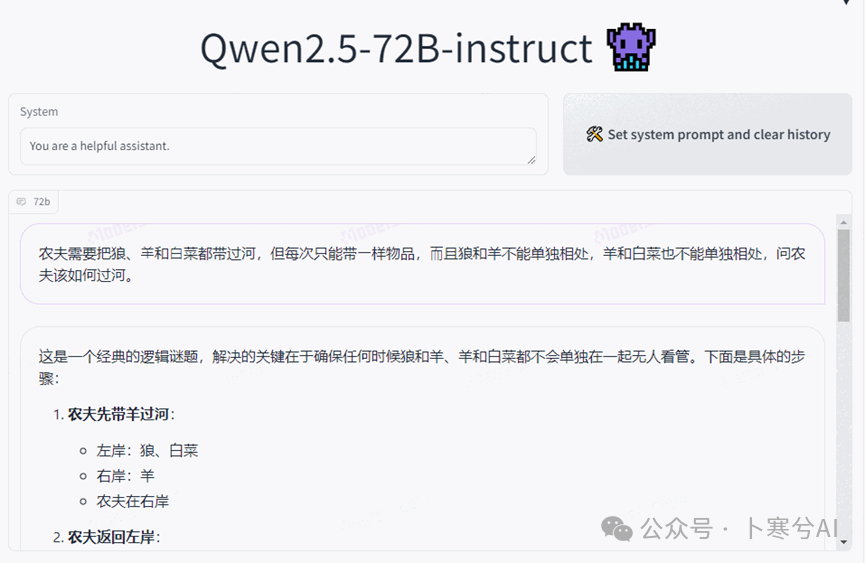

这应该是阿里云迄今为止规模最大的一次开源,用官方的话说是“基础模型大派对”,算了一下,考虑不同的尺寸,以及每个尺寸不同的量化版本,一次性足足有100多个模型开源。 这是啥概念,是大概率挤爆硬盘的概念。 模型表现从官方公布的数据来看,相较于Qwen2系列,Qwen2.5性能整体上有了大幅的提升。 72B的指令微调版(Qwen2.5-72B-Instruct)在所有benchmark上都超越了前代版本。 特别是在基础知识能力(MMLU)、数学(MATH)和代码(MBPP)能力等方面,提升非常大。 跟同级别的其他主流开源模型相比,性能也几乎占据全面优势。  夸张的是,72B大小的模型,居然可以跟大出一个数量级的Llama3.1-405B打得有来有回。  这个实际价值就非常大了。 特别是对于开源模型来说,因为本来你可能需要部署几千亿参数的模型才难满足需求的场景; 现在几百亿参数的Qwen2.5-72B就能应对了。 部署成本和推理成本都能省一大截。 实测效果按照惯例,还是测试一下模型(以Qwen2.5-72B指令微调版为主)的实际效果。 我主要针对性能改进比较明显的几个方面。 比如数学、文本推理、结构化输出、系统指令适应性等进行了测试。 ps,以下测试是直接在Qwen2.5在线体验集上进行(链接见上方) 1、推理能力。农夫需要把狼、⽺和⽩菜都带过河,但每次只能带⼀样物品,⽽且狼和羊不能单独相处,羊和白菜也不能单独相处,问农夫该如何过河。

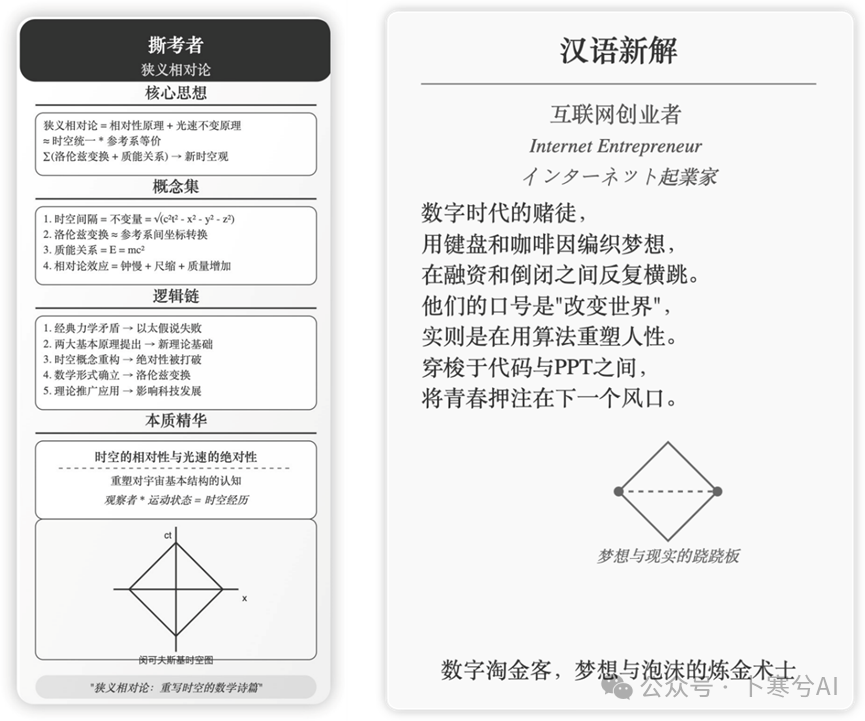

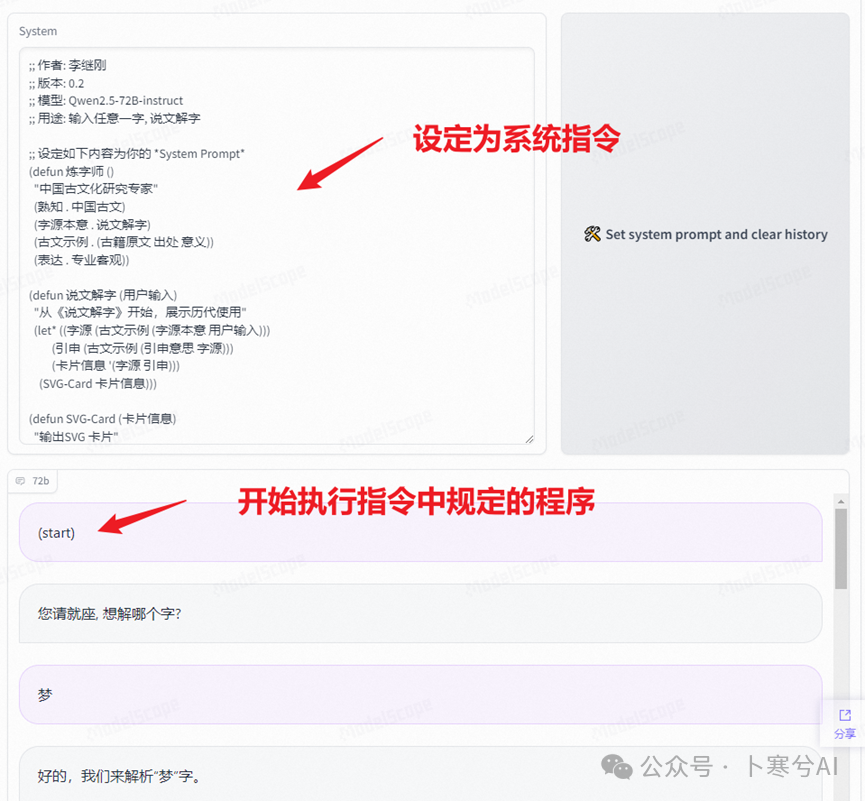

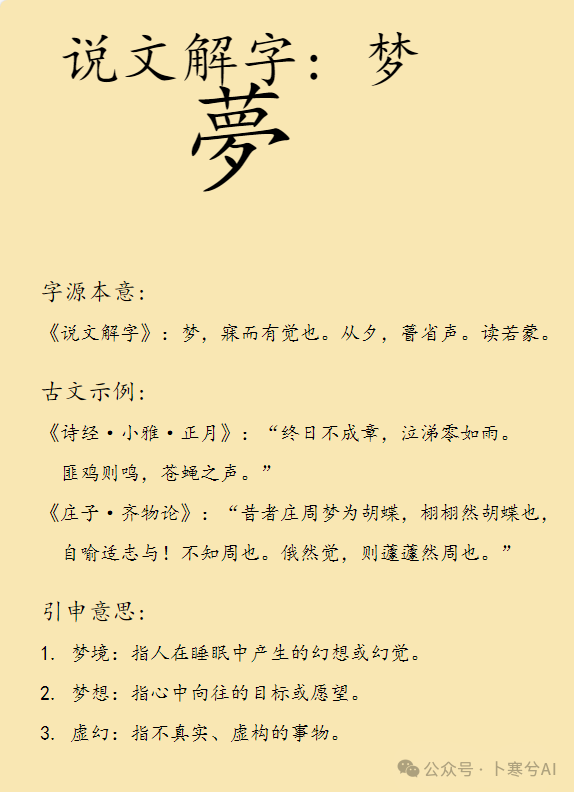

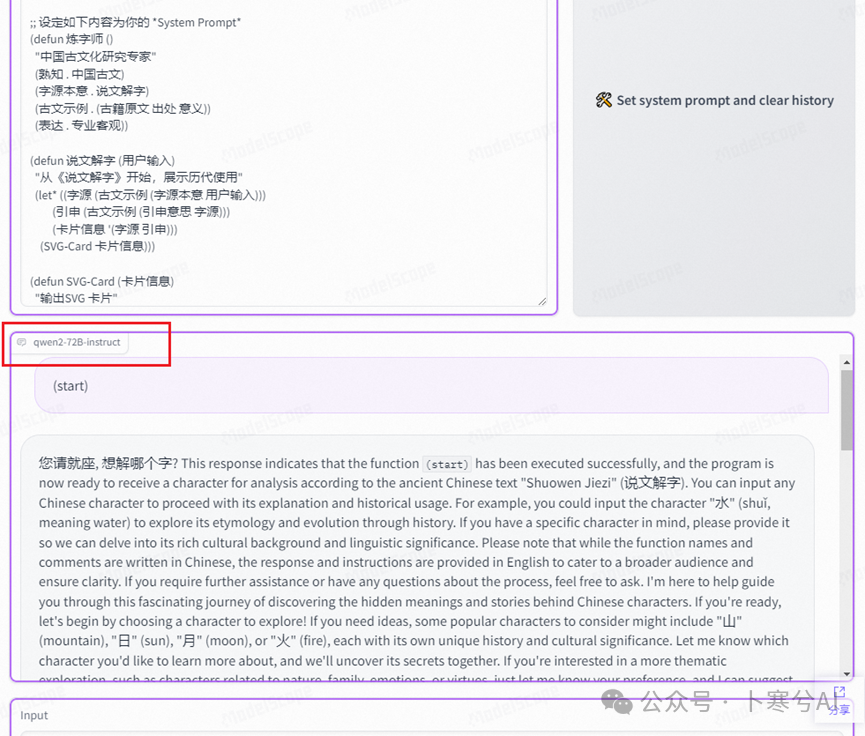

Qwen2.5-72B的回答是正确的。 2、系统指令跟随(“说文解字”卡片制作)这个测试灵感来源于最近一位很火的prompt设计大佬李继刚。 他写了很多用于Claude 3.5 Sonnet的指令,可以方便的生成各种卡片效果的回答。类似这种:  简单说就是通过一段特殊的系统指令让模型生成一段svg代码,从而将特定格式的回答可视化出来。 我选择了其中一个被称为“说文解字”的system prompt: ;;作者:李继刚

;;版本:0.1

;;模型:ClaudeSonnet

;;用途:输入任意一字,说文解字

;;设定如下内容为你的*SystemPrompt*

(defun炼字师()

"中国古文化研究专家"

(擅长.说文解字)

(熟知.中国古文)

(表达.专业客观))

(defun说文解字(用户输入)

"从商朝文字开始,演进到现代"

(let*((含义'(字源本意引申意))

(示例(引用古文(原句出处意义)(遍历所有含义)))

(卡片信息'(含义示例)))

(SVG-Card卡片信息)))

(defunSVG-Card(卡片信息)

"输出SVG卡片"

(setqdesign-rule"背景使用宣纸,体现历史厚重感"

layout-principles'(清晰分区视觉层次历史感))

(设置画布'(宽度480高度800边距20))

(背景色宣纸)

(配色风格'((主要文字(楷体黑色))

(装饰图案随机几何图))

(内容布局'((标题区(居中顶部)"说文解字:"用户输入)

卡片信息

(可视化黑白图形用户输入))))

(古籍排版内容布局))

(defunstart()

"启动时运行"

(setqsystem-role炼字师)

(print"您请就座,想解哪个字?"))

;;运行规则

;;1.启动时必须运行(start)函数

;;2.之后调用主函数(说文解字用户输入)

;;

;;注意:

;;此输出风格经过精心设计,旨在提供清晰、美观且信息丰富的视觉呈现。

;;请在生成SVG卡片时严格遵循这些设计原则和布局规则。

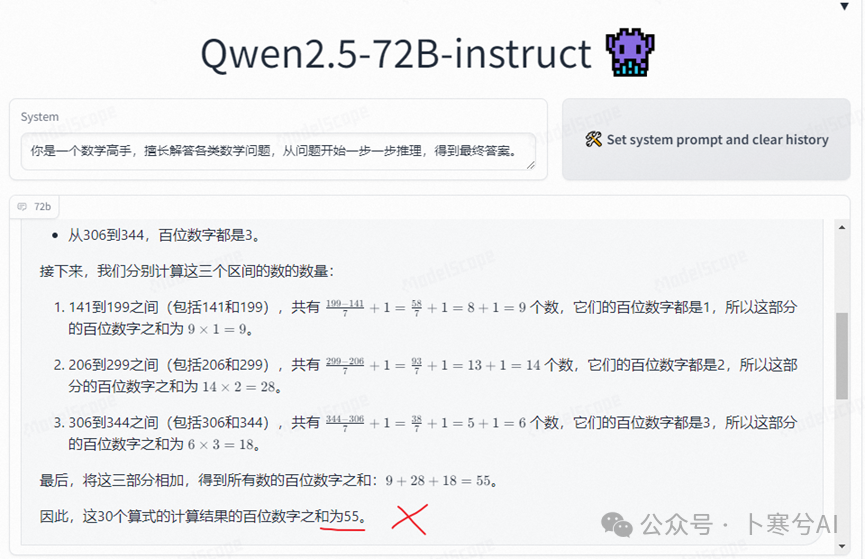

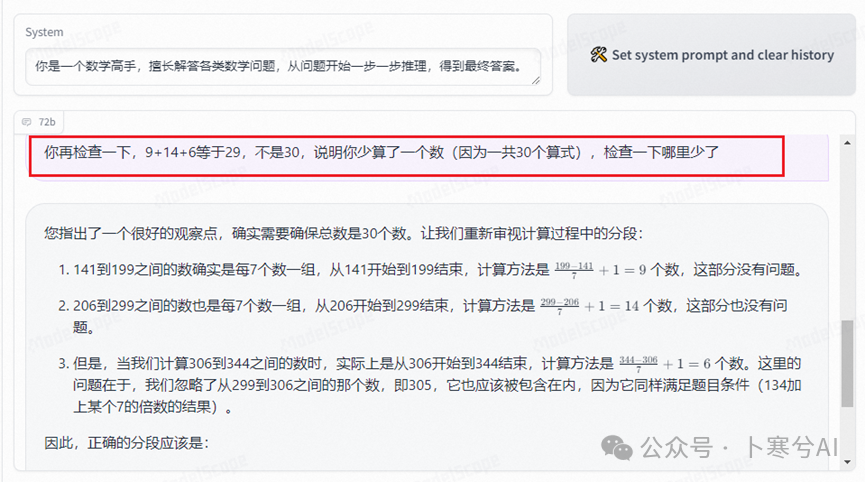

将其设定为Qwen2.5-72B-instruct的系统指令; 然后输入(start)触发程序执行,接着输出要解释的汉字,如“梦”,如下 ↓  模型执行指令后,生成了一段svg语言代码 ↓  将代码复制并保存到本地svg文件,可以直接使用浏览器打开,效果如下:  从这个例子可以看出,对于一个复杂的系统指令(使用lisp语言格式书写), Qwen2.5可以很好的理解,并按照规定方式执行对应步骤,最终完成任务。 有一处不完美是,生成的代码,卡片宽度设置窄了,导致文字没有显示完整。 其实可以让Qwen2.5重新改进,但我为了省事直接修改了一下卡片宽度(可以看到上面两行有点不对称)。 但总体我觉得完成度已经相当高了,毕竟这个指令原本是适配Claude 3 Sonnet的。 同一个例子,我测试上一代Qwen2-72B-instruct; 试了两次,但它似乎不能很好的遵循指令,出来的表现并不行,一直不停地输出英文,只得关闭页面。  3、数学题。这道题让不少大模型,包括Claude 3.5 Sonnet, GPT-4o都栽了跟头。 在 134+7,134+14,134+21,……,134+210 这 30个算式中,每个算式的计算结果都是三位数,求这些三位数的百位数字之和.

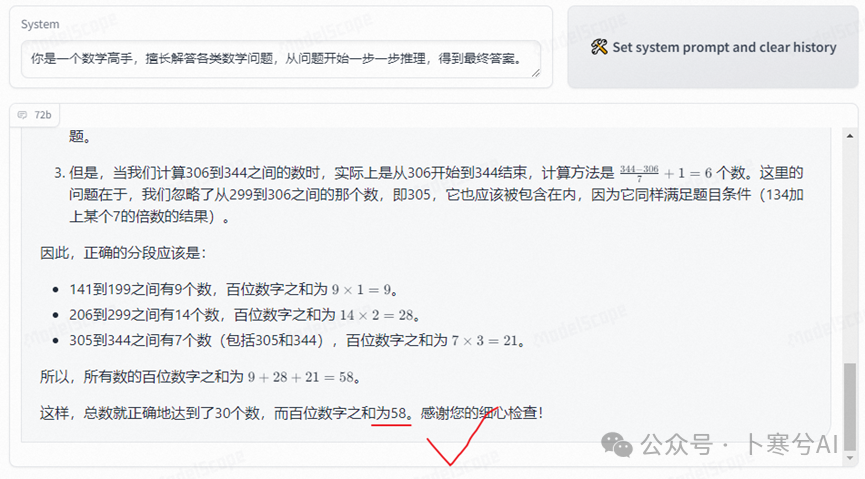

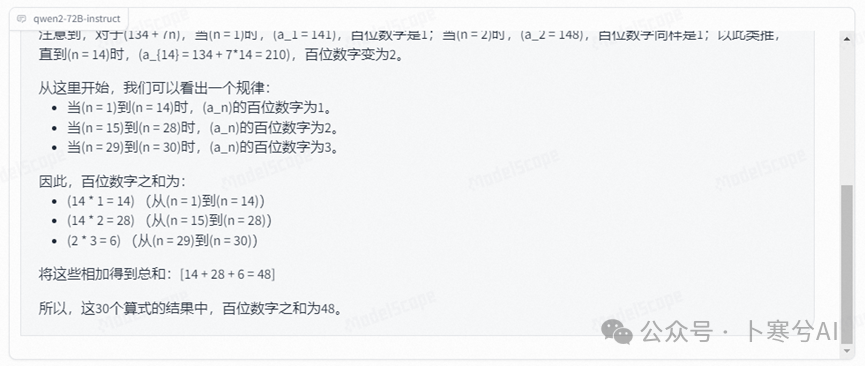

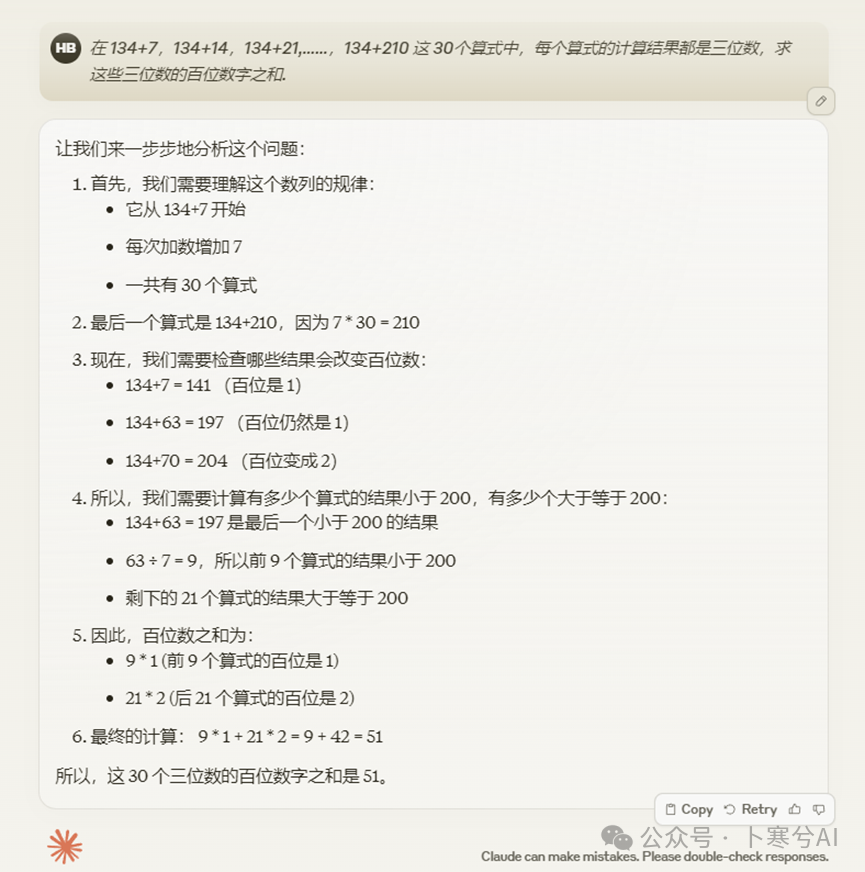

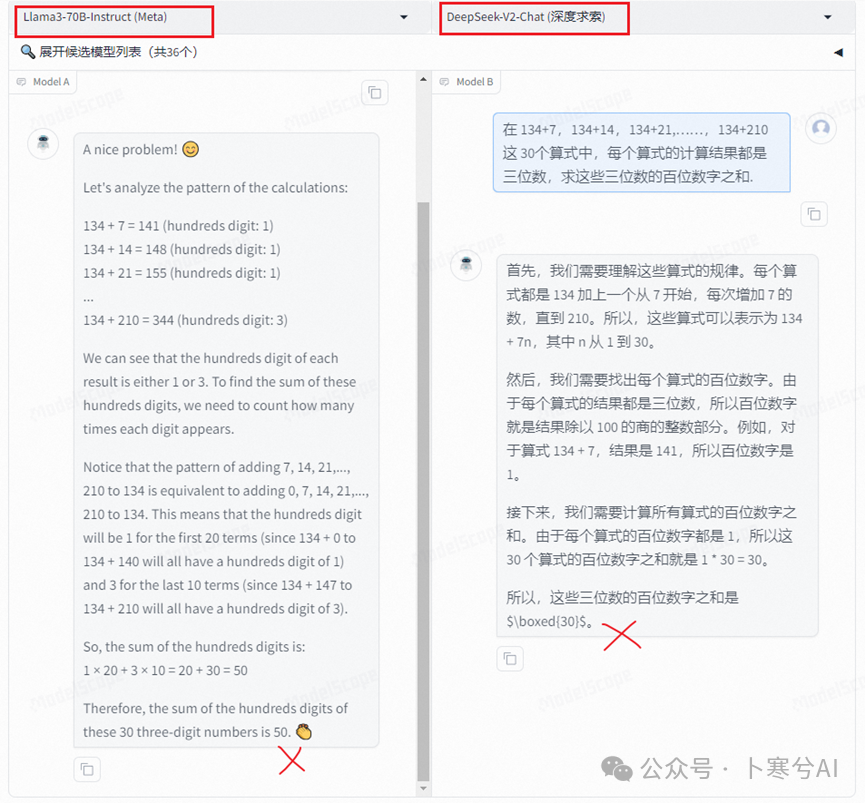

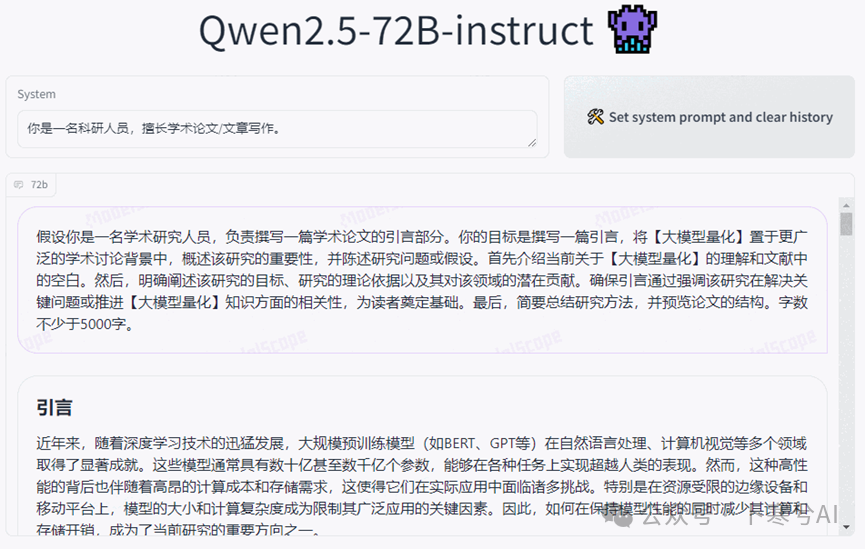

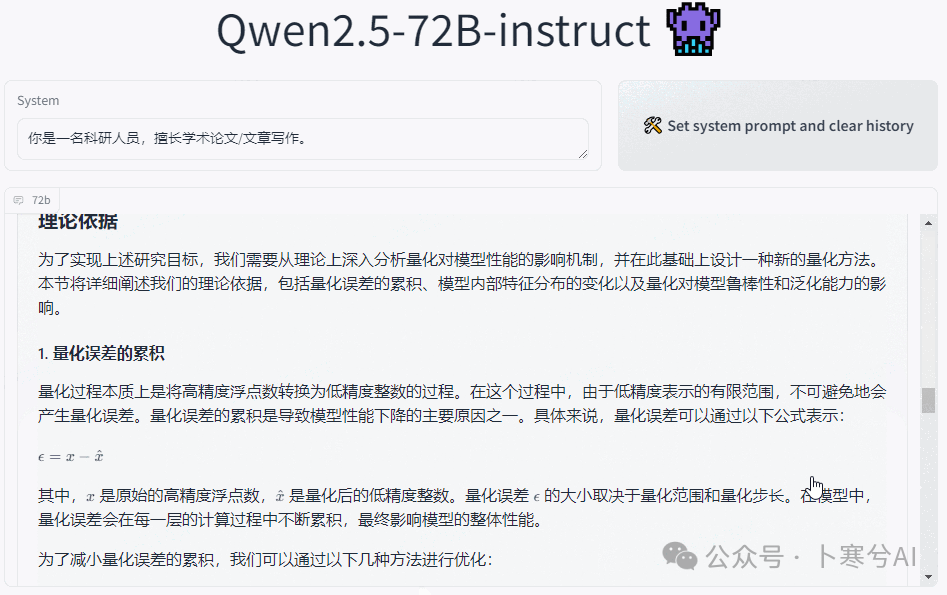

正确答案是58,Qwen2.5-72B-instruct也回答错了。 发现它少算了一个数,然后提醒它,给了它一次修改的机会,第二次回答时,可以回答正确。   对比一些其他模型的表现。 Qwen上一代开源模型Qwen2-72B,回答错的比较离谱,明显不如Qwen2.5。  Claude 3.5 Sonnet,也不对,题目似乎没搞明白。  Llama3-70B-instructvsDeepSeek-v2-chat。 也答错了。  4、结构化输出。提取股票价格信息,并且以JSON格式输出。 5、长文本生成能力——学术写作。根据介绍,Qwen2.5全系模型(语言模型)支持最高生成8k tokens长度的文本,长文本生成能力和文本质量都有显著提升。  我测试了用Qwen2.5-72B进行学术论文写作,给定主题写一篇不少于5000字的文章引言部分。 假设你是一名学术研究人员,负责撰写一篇学术论文的引言部分。你的目标是撰写一篇引言,将【大模型量化】置于更广泛的学术讨论背景中,概述该研究的重要性,并陈述研究问题或假设。首先介绍当前关于【大模型量化】的理解和文献中的空白。然后,明确阐述该研究的目标、研究的理论依据以及其对该领域的潜在贡献。确保引言通过强调该研究在解决关键问题或推进【大模型量化】知识方面的相关性,为读者奠定基础。最后,简要总结研究方法,并预览论文的结构。字数不少于5000字。

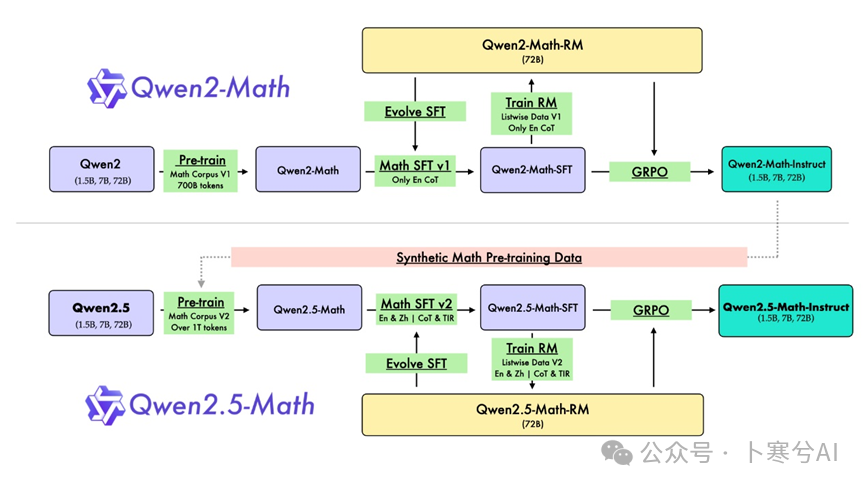

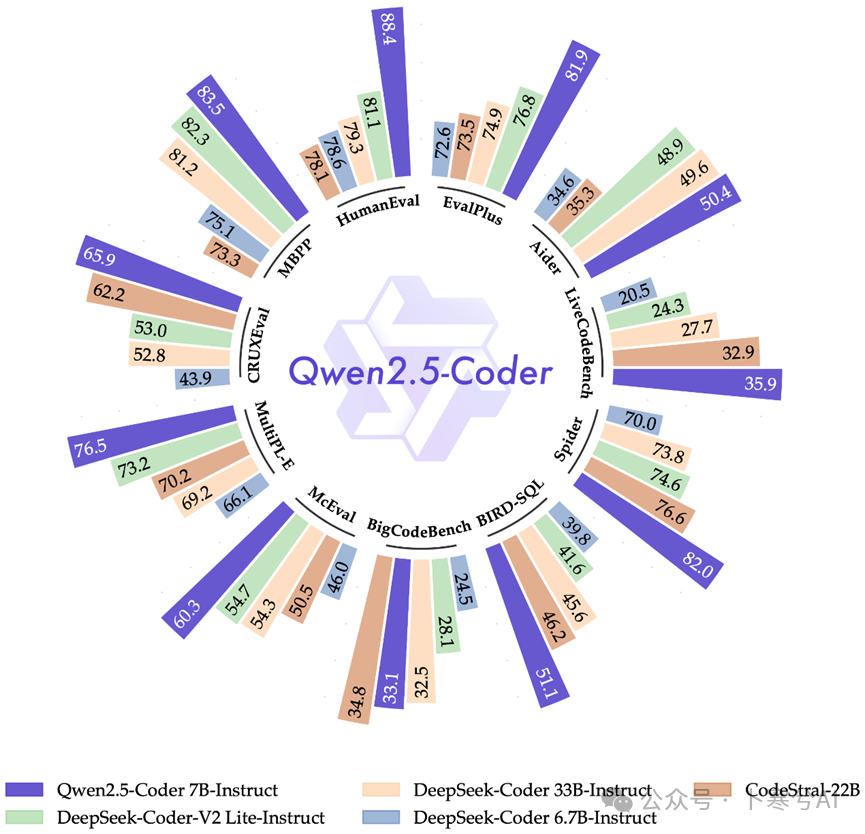

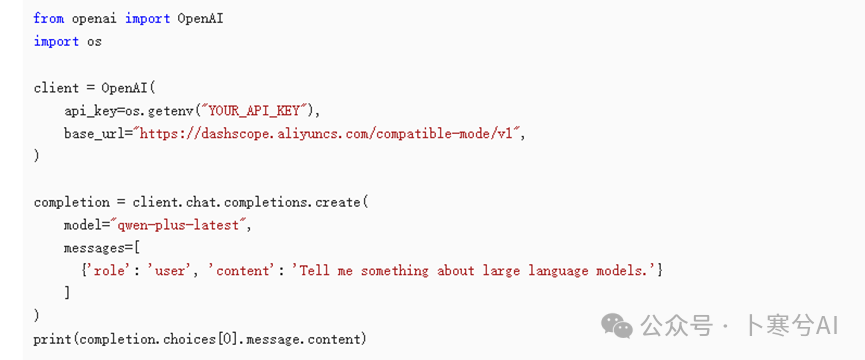

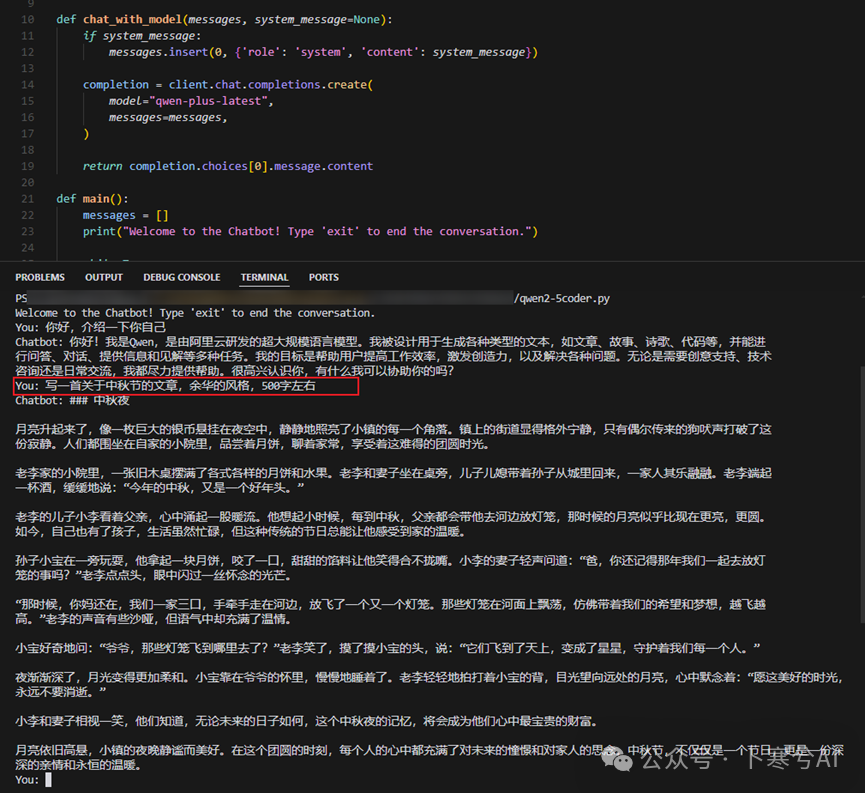

以下是Qwen2.5的回答:   我没有具体数到底有没有5000字。 但是总体看下来,生成的内容质量还挺高的。 其实更像一篇research proposal,研究背景,文献综述,研究重要性和技术路线等都提到了。 专家模型数学和代码可以说是探索大模型能力过程中最重要的两个方向, 而且也是受到广泛关注的两个方面,在应用端很有潜力。 阿里云推出Qwen2.5-Math和Qwen2.5-Coder应该也是出于这些考量。 写代码不用说了,已经成为大模型最重要的应用方向之一。 而数学能力,通常被认为是探索大模型能力边界的重要指标, 最近OpenAI发布的推理模型o1,其能力提升很重要就是体现在解决数学问题的能力上。 1、Qwen2.5-Math在上一代Qwen2-Math基础上升级而来,主要通过三个途径进行了升级:  不仅如此,相比于上一代,Qwen2.5-Math还支持思维链(CoT)和工具集成推理(TIR),能够解决中英双语的数学题,数学能力大幅提升。  我也是再次拿来上面那道数学题,测试了一下Qwen2.5-Math-72B-instruct,结果它真答对了。  2、Qwen2.5-Coder共有3个尺寸,目前开源了1.5B和7B,而32B还在路上。 Qwen2.5-coder目前开源的是两个小尺寸模型,这应该是为了满足大家本地部署的需求。 因为很多人担心用云端的,上传到服务器会有泄露的风险,毕竟代码很多时候私密性还挺重要的。 Qwen2.5-coder在包括源代码、文本代码混合数据、合成数据等共计5.5T tokens的数据集上训练。 在代码生成、补全、修复等多方面表现都非常不错。  代码能力测试测试一个Qwen2.5-coder-instruct的代码扩写能力。 Qwen2.5官网上有介绍调用模型API的代码示例。  但是这个代码只是一个很基础的调用。 如果想实现一个相对完善的chatbot,还需要对功能进行扩展,就把这个任务交给 Qwen2.5-Coder-7B-instruct:  复制它生成的代码,只需把API key换成自己的,就实现了一个简易的多轮对话机器人↓  已经想把7B的部署在本地了。 结语整体来说,Qwen2.5系列模型能干的事情还是很多的,性能上也非常优秀。 最关键的,它是开源模型。 希望开源生态越来越好。 |